Genera incorporamenti di testo utilizzando la funzione ML.GENERATE_EMBEDDING

Questo documento mostra come creare un modello remoto BigQuery ML che fa riferimento a un modello di incorporamento. Quindi, utilizzi questo modello con la

funzione ML.GENERATE_EMBEDDING

per creare incorporamenti di testo utilizzando i dati di una

tabella standard BigQuery.

Sono supportati i seguenti tipi di modelli remoti:

- Modelli remoti rispetto ai modelli di embedding Vertex AI.

- Modelli remoti su modelli aperti supportati (anteprima).

Ruoli obbligatori

Per creare un modello remoto e utilizzare la funzione ML.GENERATE_EMBEDDING, devi disporre dei seguenti ruoli IAM (Identity and Access Management):

- Crea e utilizza set di dati, tabelle e modelli BigQuery:

Editor dati BigQuery (

roles/bigquery.dataEditor) nel tuo progetto. Crea, delega e utilizza le connessioni BigQuery: Amministratore connessioni BigQuery (

roles/bigquery.connectionsAdmin) nel tuo progetto.Se non hai configurato una connessione predefinita, puoi crearne e impostarne una durante l'esecuzione dell'istruzione

CREATE MODEL. Per farlo, devi disporre del ruolo Amministratore BigQuery (roles/bigquery.admin) nel tuo progetto. Per saperne di più, vedi Configurare la connessione predefinita.Concedi le autorizzazioni al account di servizio della connessione: Amministratore IAM progetto (

roles/resourcemanager.projectIamAdmin) sul progetto che contiene l'endpoint Vertex AI. Questo è il progetto attuale per i modelli remoti che crei specificando il nome del modello come endpoint. Questo è il progetto identificato nell'URL per i modelli remoti che crei specificando un URL come endpoint.Crea job BigQuery: Utente job BigQuery (

roles/bigquery.jobUser) nel tuo progetto.

Questi ruoli predefiniti contengono le autorizzazioni necessarie per eseguire le attività descritte in questo documento. Per vedere quali sono esattamente le autorizzazioni richieste, espandi la sezione Autorizzazioni obbligatorie:

Autorizzazioni obbligatorie

- Crea un set di dati:

bigquery.datasets.create - Crea, delega e utilizza una connessione:

bigquery.connections.* - Imposta le autorizzazioni del account di servizio:

resourcemanager.projects.getIamPolicyeresourcemanager.projects.setIamPolicy - Crea un modello ed esegui l'inferenza:

bigquery.jobs.createbigquery.models.createbigquery.models.getDatabigquery.models.updateDatabigquery.models.updateMetadata

- Esegui query sui dati della tabella:

bigquery.tables.getData

Potresti anche ottenere queste autorizzazioni con ruoli personalizzati o altri ruoli predefiniti.

Prima di iniziare

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the BigQuery, BigQuery Connection, and Vertex AI APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.

Crea un set di dati

Crea un set di dati BigQuery che contenga le tue risorse:

Console

Nella console Google Cloud , vai alla pagina BigQuery.

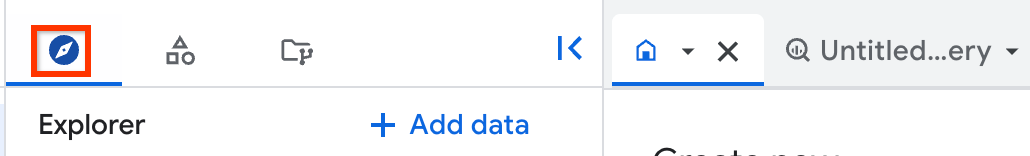

Nel riquadro a sinistra, fai clic su Explorer:

Se non vedi il riquadro a sinistra, fai clic su Espandi riquadro a sinistra per aprirlo.

Nel riquadro Explorer, fai clic sul nome del progetto.

Fai clic su Visualizza azioni > Crea set di dati.

Nella pagina Crea set di dati:

In ID set di dati, digita un nome per il set di dati.

Per Tipo di località, seleziona Regione o Più regioni.

- Se hai selezionato Regione, seleziona una località dall'elenco Regione.

- Se hai selezionato Più regioni, seleziona Stati Uniti o Europa dall'elenco Più regioni.

Fai clic su Crea set di dati.

bq

Per creare un nuovo set di dati, utilizza il comando

bq mkcon il flag--location:bq --location=LOCATION mk -d DATASET_ID

Sostituisci quanto segue:

LOCATION: la posizione del set di dati.DATASET_IDè l'ID del set di dati che stai creando.

Verifica che il set di dati sia stato creato:

bq ls

Crea una connessione

Puoi saltare questo passaggio se hai configurato una connessione predefinita o se disponi del ruolo Amministratore BigQuery.

Crea una connessione a una risorsa Cloud da utilizzare per il modello remoto e recupera il account di servizio della connessione. Crea la connessione nella stessa posizione del set di dati creato nel passaggio precedente.

Seleziona una delle seguenti opzioni:

Console

Vai alla pagina BigQuery.

Nel riquadro Explorer, fai clic su Aggiungi dati:

Si apre la finestra di dialogo Aggiungi dati.

Nel riquadro Filtra per, nella sezione Tipo di origine dati, seleziona Applicazioni aziendali.

In alternativa, nel campo Cerca origini dati, puoi inserire

Vertex AI.Nella sezione Origini dati in evidenza, fai clic su Vertex AI.

Fai clic sulla scheda della soluzione Vertex AI Models: BigQuery Federation.

Nell'elenco Tipo di connessione, seleziona Modelli remoti di Vertex AI, funzioni remote, BigLake e Spanner (risorsa Cloud).

Nel campo ID connessione, inserisci un nome per la connessione.

Fai clic su Crea connessione.

Fai clic su Vai alla connessione.

Nel riquadro Informazioni sulla connessione, copia l'ID del account di servizio da utilizzare in un passaggio successivo.

bq

In un ambiente a riga di comando, crea una connessione:

bq mk --connection --location=REGION --project_id=PROJECT_ID \ --connection_type=CLOUD_RESOURCE CONNECTION_ID

Il parametro

--project_idsostituisce il progetto predefinito.Sostituisci quanto segue:

REGION: la tua regione di connessionePROJECT_ID: il tuo ID progetto Google CloudCONNECTION_ID: un ID per la tua connessione

Quando crei una risorsa di connessione, BigQuery crea un account di serviziot di sistema univoco e lo associa alla connessione.

Risoluzione dei problemi: se viene visualizzato il seguente errore di connessione, aggiorna Google Cloud SDK:

Flags parsing error: flag --connection_type=CLOUD_RESOURCE: value should be one of...

Recupera e copia l'ID account di servizio da utilizzare in un passaggio successivo:

bq show --connection PROJECT_ID.REGION.CONNECTION_ID

L'output è simile al seguente:

name properties 1234.REGION.CONNECTION_ID {"serviceAccountId": "connection-1234-9u56h9@gcp-sa-bigquery-condel.iam.gserviceaccount.com"}

Terraform

Utilizza la risorsa

google_bigquery_connection.

Per eseguire l'autenticazione in BigQuery, configura le credenziali predefinite dell'applicazione. Per saperne di più, vedi Configurare l'autenticazione per le librerie client.

L'esempio seguente crea una connessione di risorsa Cloud denominata

my_cloud_resource_connection nella regione US:

Per applicare la configurazione di Terraform in un progetto Google Cloud , completa i passaggi nelle sezioni seguenti.

Prepara Cloud Shell

- Avvia Cloud Shell.

-

Imposta il progetto Google Cloud predefinito in cui vuoi applicare le configurazioni Terraform.

Devi eseguire questo comando una sola volta per progetto e puoi eseguirlo in qualsiasi directory.

export GOOGLE_CLOUD_PROJECT=PROJECT_ID

Le variabili di ambiente vengono sostituite se imposti valori espliciti nel file di configurazione Terraform.

Prepara la directory

Ogni file di configurazione Terraform deve avere la propria directory (chiamata anche modulo radice).

-

In Cloud Shell, crea una directory e un nuovo file al suo interno. Il nome file deve avere l'estensione

.tf, ad esempiomain.tf. In questo tutorial, il file viene denominatomain.tf.mkdir DIRECTORY && cd DIRECTORY && touch main.tf

-

Se stai seguendo un tutorial, puoi copiare il codice campione in ogni sezione o passaggio.

Copia il codice campione nel

main.tfappena creato.(Facoltativo) Copia il codice da GitHub. Questa operazione è consigliata quando lo snippet Terraform fa parte di una soluzione end-to-end.

- Rivedi e modifica i parametri di esempio da applicare al tuo ambiente.

- Salva le modifiche.

-

Inizializza Terraform. Devi effettuare questa operazione una sola volta per directory.

terraform init

(Facoltativo) Per utilizzare l'ultima versione del provider Google, includi l'opzione

-upgrade:terraform init -upgrade

Applica le modifiche

-

Rivedi la configurazione e verifica che le risorse che Terraform creerà o

aggiornerà corrispondano alle tue aspettative:

terraform plan

Apporta le correzioni necessarie alla configurazione.

-

Applica la configurazione di Terraform eseguendo il comando seguente e inserendo

yesal prompt:terraform apply

Attendi che Terraform visualizzi il messaggio "Apply complete!".

- Apri il tuo Google Cloud progetto per visualizzare i risultati. Nella console Google Cloud , vai alle risorse nell'interfaccia utente per assicurarti che Terraform le abbia create o aggiornate.

Concedi un ruolo al account di servizio della connessione al modello remoto

Devi concedere all'account di servizio della connessione il ruolo Utente Vertex AI.

Se prevedi di specificare l'endpoint come URL quando crei il modello remoto,

ad esempio

endpoint = 'https://us-central1-aiplatform.googleapis.com/v1/projects/myproject/locations/us-central1/publishers/google/models/text-embedding-005',

concedi questo ruolo nello stesso progetto specificato nell'URL.

Se prevedi di specificare l'endpoint utilizzando il nome del modello quando crei

il modello remoto, ad esempio endpoint = 'text-embedding-005', concedi questo

ruolo nello stesso progetto in cui prevedi di creare il modello remoto.

La concessione del ruolo in un progetto diverso genera l'errore

bqcx-1234567890-wxyz@gcp-sa-bigquery-condel.iam.gserviceaccount.com does not have the permission to access resource.

Per concedere il ruolo, segui questi passaggi:

Console

Vai alla pagina IAM e amministrazione.

Fai clic su Concedi l'accesso.

Si apre la finestra di dialogo Aggiungi entità.

Nel campo Nuove entità, inserisci l'ID account di servizio che hai copiato in precedenza.

Nel campo Seleziona un ruolo, seleziona Vertex AI, quindi seleziona Utente Vertex AI.

Fai clic su Salva.

gcloud

Utilizza il

comando gcloud projects add-iam-policy-binding:

gcloud projects add-iam-policy-binding 'PROJECT_NUMBER' --member='serviceAccount:MEMBER' --role='roles/aiplatform.user' --condition=None

Sostituisci quanto segue:

PROJECT_NUMBER: il numero di progettoMEMBER: l'ID account di servizio che hai copiato in precedenza

Scegliere un metodo di deployment del modello aperto

Se crei un modello remoto su un modello aperto supportato, puoi eseguire automaticamente il deployment del modello aperto contemporaneamente alla creazione del modello remoto specificando l'ID modello di Vertex AI Model Garden o Hugging Face nell'istruzione CREATE MODEL.

In alternativa, puoi prima eseguire il deployment del modello open source e poi utilizzarlo

con il modello remoto specificando l'endpoint del modello

nell'istruzione CREATE MODEL. Per saperne di più, vedi

Eseguire il deployment di modelli aperti.

Crea un modello remoto BigQuery ML

Creare un modello remoto:

Nuovi modelli aperti

Nella console Google Cloud , vai alla pagina BigQuery.

Utilizzando l'editor SQL, crea un modello remoto:

CREATE OR REPLACE MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME` REMOTE WITH CONNECTION {DEFAULT | `PROJECT_ID.REGION.CONNECTION_ID`} OPTIONS ( {HUGGING_FACE_MODEL_ID = 'HUGGING_FACE_MODEL_ID' | MODEL_GARDEN_MODEL_NAME = 'MODEL_GARDEN_MODEL_NAME'} [, HUGGING_FACE_TOKEN = 'HUGGING_FACE_TOKEN' ] [, MACHINE_TYPE = 'MACHINE_TYPE' ] [, MIN_REPLICA_COUNT = MIN_REPLICA_COUNT ] [, MAX_REPLICA_COUNT = MAX_REPLICA_COUNT ] [, RESERVATION_AFFINITY_TYPE = {'NO_RESERVATION' | 'ANY_RESERVATION' | 'SPECIFIC_RESERVATION'} ] [, RESERVATION_AFFINITY_KEY = 'compute.googleapis.com/reservation-name' ] [, RESERVATION_AFFINITY_VALUES = RESERVATION_AFFINITY_VALUES ] [, ENDPOINT_IDLE_TTL = ENDPOINT_IDLE_TTL ] );

Sostituisci quanto segue:

PROJECT_ID: il tuo ID progetto.DATASET_ID: l'ID del set di dati che deve contenere il modello. Questo set di dati deve trovarsi nella stessa posizione della connessione che stai utilizzando.MODEL_NAME: il nome del modello.REGION: la regione utilizzata dalla connessione.CONNECTION_ID: l'ID della tua connessione BigQuery.Puoi ottenere questo valore visualizzando i dettagli della connessione nella console Google Cloud e copiando il valore nell'ultima sezione dell'ID connessione completo mostrato in ID connessione. Ad esempio,

projects/myproject/locations/connection_location/connections/myconnection.HUGGING_FACE_MODEL_ID: un valoreSTRINGche specifica l'ID modello per un modello Hugging Face supportato, nel formatoprovider_name/model_name. Ad esempio,deepseek-ai/DeepSeek-R1. Puoi ottenere l'ID modello facendo clic sul nome del modello in Hugging Face Model Hub e poi copiando l'ID modello dalla parte superiore della scheda del modello.MODEL_GARDEN_MODEL_NAME: un valoreSTRINGche specifica l'ID modello e la versione del modello di un modello Model Garden di Vertex AI supportato, nel formatopublishers/publisher/models/model_name@model_version. Ad esempio,publishers/openai/models/gpt-oss@gpt-oss-120b. Puoi ottenere l'ID modello facendo clic sulla scheda del modello in Vertex AI Model Garden e poi copiando l'ID dal campo ID modello. Puoi ottenere la versione predefinita del modello copiandola dal campo Versione nella scheda del modello. Per visualizzare altre versioni del modello che puoi utilizzare, fai clic su Esegui il deployment del modello e poi sul campo ID risorsa.HUGGING_FACE_TOKEN: un valoreSTRINGche specifica il token di accesso utente di Hugging Face da utilizzare. Puoi specificare un valore per questa opzione solo se specifichi anche un valore per l'opzioneHUGGING_FACE_MODEL_ID.Il token deve avere almeno il ruolo

read, ma sono accettabili anche token con un ambito più ampio. Questa opzione è obbligatoria quando il modello identificato dal valoreHUGGING_FACE_MODEL_IDè un modello con accesso limitato o privato di Hugging Face.Alcuni modelli controllati richiedono l'accettazione esplicita dei termini di servizio prima di concedere l'accesso. Per accettare questi termini, segui questi passaggi:

- Vai alla pagina del modello sul sito web di Hugging Face.

- Individua e leggi i termini di servizio del modello. Un link al contratto di servizio si trova in genere nella scheda del modello.

- Accetta i termini come richiesto nella pagina.

MACHINE_TYPE: un valoreSTRINGche specifica il tipo di macchina da utilizzare durante il deployment del modello su Vertex AI. Per informazioni sui tipi di macchina supportati, vedi Tipi di macchina. Se non specifichi un valore per l'opzioneMACHINE_TYPE, viene utilizzato il tipo di macchina predefinito di Vertex AI Model Garden per il modello.MIN_REPLICA_COUNT: un valoreINT64che specifica il numero minimo di repliche della macchina utilizzate durante il deployment del modello su un endpoint Vertex AI. Il servizio aumenta o diminuisce il numero di repliche in base al carico di inferenza sull'endpoint. Il numero di repliche utilizzate non è mai inferiore al valoreMIN_REPLICA_COUNTe mai superiore al valoreMAX_REPLICA_COUNT. Il valore diMIN_REPLICA_COUNTdeve essere compreso nell'intervallo[1, 4096]. Il valore predefinito è1.MAX_REPLICA_COUNT: un valoreINT64che specifica il numero massimo di repliche della macchina utilizzate durante il deployment del modello su un endpoint Vertex AI. Il servizio aumenta o diminuisce il numero di repliche in base al carico di inferenza sull'endpoint. Il numero di repliche utilizzate non è mai inferiore al valoreMIN_REPLICA_COUNTe mai superiore al valoreMAX_REPLICA_COUNT. Il valore diMAX_REPLICA_COUNTdeve essere compreso nell'intervallo[1, 4096]. Il valore predefinito è il valoreMIN_REPLICA_COUNT.RESERVATION_AFFINITY_TYPE: determina se il modello di cui è stato eseguito il deployment utilizza le prenotazioni di Compute Engine per garantire la disponibilità delle macchine virtuali (VM) durante la pubblicazione delle previsioni e specifica se il modello utilizza le VM di tutte le prenotazioni disponibili o solo di una prenotazione specifica. Per ulteriori informazioni, consulta Affinità di prenotazione di Compute Engine.Puoi utilizzare solo le prenotazioni Compute Engine condivise con Vertex AI. Per saperne di più, vedi Consentire l'utilizzo di una prenotazione.

I valori supportati sono i seguenti:

NO_RESERVATION: non viene consumata alcuna prenotazione quando il modello viene sottoposto a deployment in un endpoint Vertex AI. La specifica diNO_RESERVATIONha lo stesso effetto della mancata specifica di un'affinità di prenotazione.ANY_RESERVATION: il deployment del modello Vertex AI utilizza macchine virtuali (VM) dalle prenotazioni Compute Engine che si trovano nel progetto corrente o che sono condivise con il progetto e che sono configurate per l'utilizzo automatico. Vengono utilizzate solo le VM che soddisfano i seguenti requisiti:- Utilizzano il tipo di macchina specificato dal valore

MACHINE_TYPE. - Se il set di dati BigQuery in cui stai creando il modello remoto si trova in una singola regione, la prenotazione deve trovarsi nella stessa regione. Se il set di dati

si trova nella multiregione

US, la prenotazione deve trovarsi nella regioneus-central1. Se il set di dati si trova nellaEUmultiregione, la prenotazione deve trovarsi nella regioneeurope-west4.

Se non è presente capacità sufficiente nelle prenotazioni disponibili o se non vengono trovate prenotazioni adatte, il sistema esegue il provisioning delle VM Compute Engine on demand per soddisfare i requisiti delle risorse.

- Utilizzano il tipo di macchina specificato dal valore

SPECIFIC_RESERVATION: il deployment del modello Vertex AI utilizza le VM solo dalla prenotazione specificata nel valoreRESERVATION_AFFINITY_VALUES. Questa prenotazione deve essere configurata per il consumo con target specifico. Il deployment non riesce se la prenotazione specificata non ha capacità sufficiente.

RESERVATION_AFFINITY_KEY: la stringacompute.googleapis.com/reservation-name. Devi specificare questa opzione quando il valore diRESERVATION_AFFINITY_TYPEèSPECIFIC_RESERVATION.RESERVATION_AFFINITY_VALUES: un valoreARRAY<STRING>che specifica il nome completo della risorsa della prenotazione Compute Engine, nel seguente formato:

projects/myproject/zones/reservation_zone/reservations/reservation_nameAd esempio,

RESERVATION_AFFINITY_values = ['projects/myProject/zones/us-central1-a/reservations/myReservationName'].Puoi ottenere il nome e la zona della prenotazione dalla pagina Prenotazioni della console Google Cloud . Per ulteriori informazioni, vedi Visualizzare le prenotazioni.

Devi specificare questa opzione quando il valore di

RESERVATION_AFFINITY_TYPEèSPECIFIC_RESERVATION.ENDPOINT_IDLE_TTL: un valoreINTERVALche specifica la durata dell'inattività dopo la quale il modello aperto viene automaticamente annullato il deployment dall'endpoint Vertex AI.Per attivare l'annullamento automatico del deployment, specifica un valore letterale di intervallo compreso tra 390 minuti (6,5 ore) e 7 giorni. Ad esempio, specifica

INTERVAL 8 HOURper annullare il deployment del modello dopo 8 ore di inattività. Il valore predefinito è 390 minuti (6 ore e mezza).L'inattività del modello è definita come il periodo di tempo trascorso dall'esecuzione di una delle seguenti operazioni sul modello:

- Esecuzione dell'istruzione

CREATE MODEL. - Eseguendo l'istruzione

ALTER MODELcon l'argomentoDEPLOY_MODELimpostato suTRUE. - Invio di una richiesta di inferenza all'endpoint del modello. Ad esempio, eseguendo la funzione

ML.GENERATE_EMBEDDINGoML.GENERATE_TEXT.

Ognuna di queste operazioni azzera il timer di inattività. Il ripristino viene attivato all'inizio del job BigQuery che esegue l'operazione.

Dopo l'annullamento del deployment del modello, le richieste di inferenza inviate al modello restituiscono un errore. L'oggetto modello BigQuery rimane invariato, inclusi i metadati del modello. Per utilizzare di nuovo il modello per l'inferenza, devi eseguire nuovamente il deployment eseguendo l'istruzione

ALTER MODELsul modello e impostando l'opzioneDEPLOY_MODELsuTRUE.- Esecuzione dell'istruzione

Modelli aperti di cui è stato eseguito il deployment

Nella console Google Cloud , vai alla pagina BigQuery.

Utilizzando l'editor SQL, crea un modello remoto:

CREATE OR REPLACE MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME` REMOTE WITH CONNECTION {DEFAULT | `PROJECT_ID.REGION.CONNECTION_ID`} OPTIONS ( ENDPOINT = 'https://ENDPOINT_REGION-aiplatform.googleapis.com/v1/projects/ENDPOINT_PROJECT_ID/locations/ENDPOINT_REGION/endpoints/ENDPOINT_ID' );

Sostituisci quanto segue:

PROJECT_ID: il tuo ID progetto.DATASET_ID: l'ID del set di dati che deve contenere il modello. Questo set di dati deve trovarsi nella stessa posizione della connessione che stai utilizzando.MODEL_NAME: il nome del modello.REGION: la regione utilizzata dalla connessione.CONNECTION_ID: l'ID della tua connessione BigQuery.Puoi ottenere questo valore visualizzando i dettagli della connessione nella console Google Cloud e copiando il valore nell'ultima sezione dell'ID connessione completo mostrato in ID connessione. Ad esempio,

projects/myproject/locations/connection_location/connections/myconnection.ENDPOINT_REGION: la regione in cui viene eseguito il deployment del modello aperto.ENDPOINT_PROJECT_ID: il progetto in cui viene implementato il modello aperto.ENDPOINT_ID: l'ID dell'endpoint HTTPS utilizzato dal modello aperto. Puoi ottenere l'ID endpoint individuando il modello aperto nella pagina Previsione online e copiando il valore nel campo ID.

Tutti gli altri modelli

Nella console Google Cloud , vai alla pagina BigQuery.

Utilizzando l'editor SQL, crea un modello remoto:

CREATE OR REPLACE MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME` REMOTE WITH CONNECTION {DEFAULT | `PROJECT_ID.REGION.CONNECTION_ID`} OPTIONS (ENDPOINT = 'ENDPOINT');

Sostituisci quanto segue:

PROJECT_ID: il tuo ID progetto.DATASET_ID: l'ID del set di dati che deve contenere il modello. Questo set di dati deve trovarsi nella stessa posizione della connessione che stai utilizzando.MODEL_NAME: il nome del modello.REGION: la regione utilizzata dalla connessione.CONNECTION_ID: l'ID della tua connessione BigQuery.Puoi ottenere questo valore visualizzando i dettagli della connessione nella console Google Cloud e copiando il valore nell'ultima sezione dell'ID connessione completo mostrato in ID connessione. Ad esempio,

projects/myproject/locations/connection_location/connections/myconnection.ENDPOINT: il nome di un modello di embedding da utilizzare. Per ulteriori informazioni, vediENDPOINT.Il modello Vertex AI che specifichi deve essere disponibile nella località in cui stai creando il modello remoto. Per ulteriori informazioni, consulta Località.

Generare incorporamenti di testo

Genera embedding di testo con la

funzione ML.GENERATE_EMBEDDING

utilizzando i dati di testo di una colonna di una tabella o di una query.

In genere, si utilizza un modello di incorporamento di testo per i casi d'uso solo di testo e un modello di incorporamento multimodale per i casi d'uso di ricerca cross-modale, in cui gli incorporamenti per testo e contenuti visivi vengono generati nello stesso spazio semantico.

Vertex AI Text

Genera text embedding utilizzando un modello remoto su un modello di text embedding Vertex AI:

SELECT * FROM ML.GENERATE_EMBEDDING( MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME`, {TABLE PROJECT_ID.DATASET_ID.TABLE_NAME | (CONTENT_QUERY)}, STRUCT(FLATTEN_JSON AS flatten_json_output, TASK_TYPE AS task_type, OUTPUT_DIMENSIONALITY AS output_dimensionality) );

Sostituisci quanto segue:

PROJECT_ID: il tuo ID progetto.DATASET_ID: l'ID del set di dati che contiene il modello.MODEL_NAME: il nome del modello remoto su un modello di embedding.TABLE_NAME: il nome della tabella che contiene il testo da incorporare. Questa tabella deve avere una colonna denominatacontentoppure puoi utilizzare un alias per utilizzare una colonna con un nome diverso.CONTENT_QUERY: una query il cui risultato contiene una colonnaSTRINGdenominatacontent.FLATTEN_JSON: un valoreBOOLche indica se analizzare l'incorporamento in una colonna separata. Il valore predefinito èTRUE.TASK_TYPE: unSTRINGvalore letterale che specifica l'applicazione downstream prevista per aiutare il modello a produrre incorporamenti di qualità migliore.TASK_TYPEaccetta i seguenti valori:RETRIEVAL_QUERY: specifica che il testo indicato è una query in un'impostazione di ricerca o recupero.RETRIEVAL_DOCUMENT: specifica che il testo indicato è un documento in un'impostazione di ricerca o recupero.Quando utilizzi questo tipo di attività, è utile includere il titolo del documento nell'istruzione della query per migliorare la qualità dell'incorporamento. Il titolo del documento deve trovarsi in una colonna denominata

titleo con aliastitle, ad esempio:SELECT * FROM ML.GENERATE_EMBEDDING( MODEL

mydataset.embedding_model, (SELECT abstract as content, header as title, publication_number FROMmydataset.publications), STRUCT(TRUE AS flatten_json_output, 'RETRIEVAL_DOCUMENT' as task_type) );Se specifichi la colonna del titolo nella query di input, il campo

titledel corpo della richiesta inviata al modello viene compilato. Se specifichi un valoretitlequando utilizzi qualsiasi altro tipo di attività, l'input viene ignorato e non ha alcun effetto sui risultati dell'incorporamento.SEMANTIC_SIMILARITY: specifica che il testo fornito verrà utilizzato per la similarità semantica del testo (STS).CLASSIFICATION: specifica che gli embedding verranno utilizzati per la classificazione.CLUSTERING: specifica che gli embedding verranno utilizzati per il clustering.QUESTION_ANSWERING: specifica che gli embedding verranno utilizzati per rispondere alle domande.FACT_VERIFICATION: specifica che gli embedding verranno utilizzati per la verifica dei fatti.CODE_RETRIEVAL_QUERY: specifica che gli embedding verranno utilizzati per il recupero del codice.

OUTPUT_DIMENSIONALITY: un valoreINT64che specifica il numero di dimensioni da utilizzare per generare gli incorporamenti. Ad esempio, se specifichi256 AS output_dimensionality, la colonna di outputml_generate_embedding_resultcontiene 256 incorporamenti per ogni valore di input.Per i modelli remoti con più di

gemini-embedding-001modelli, il valoreOUTPUT_DIMENSIONALITYdeve rientrare nell'intervallo[1, 3072]. Il valore predefinito è3072. Per i modelli remoti superiori atext-embeddingotext-multilingual-embedding, il valoreOUTPUT_DIMENSIONALITYdeve essere compreso nell'intervallo[1, 768]. Il valore predefinito è768.Se utilizzi un modello remoto su un modello

text-embedding, la versione del modellotext-embeddingdeve esseretext-embedding-004o successiva. Se utilizzi un modello remoto su un modellotext-multilingual-embedding, la versione del modellotext-multilingual-embeddingdeve esseretext-multilingual-embedding-002o successiva.

Esempio: incorporare testo in una tabella

L'esempio seguente mostra una richiesta di incorporamento della colonna content della tabella text_data:

SELECT * FROM ML.GENERATE_EMBEDDING( MODEL `mydataset.embedding_model`, TABLE mydataset.text_data, STRUCT(TRUE AS flatten_json_output, 'CLASSIFICATION' AS task_type) );

Testo aperto

Genera embedding di testo utilizzando un modello remoto su un modello di embedding aperto:

SELECT * FROM ML.GENERATE_EMBEDDING( MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME`, {TABLE PROJECT_ID.DATASET_ID.TABLE_NAME | (CONTENT_QUERY)}, STRUCT(FLATTEN_JSON AS flatten_json_output) );

Sostituisci quanto segue:

PROJECT_ID: il tuo ID progetto.DATASET_ID: l'ID del set di dati che contiene il modello.MODEL_NAME: il nome del modello remoto su un modello di embedding.TABLE_NAME: il nome della tabella che contiene il testo da incorporare. Questa tabella deve avere una colonna denominatacontentoppure puoi utilizzare un alias per utilizzare una colonna con un nome diverso.CONTENT_QUERY: una query il cui risultato contiene una colonnaSTRINGdenominatacontent.FLATTEN_JSON: un valoreBOOLche indica se analizzare l'incorporamento in una colonna separata. Il valore predefinito èTRUE.

Vertex AI multimodale

Genera text embedding utilizzando un modello remoto su un modello di embedding multimodale Vertex AI:

SELECT * FROM ML.GENERATE_EMBEDDING( MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME`, {TABLE PROJECT_ID.DATASET_ID.TABLE_NAME | (CONTENT_QUERY)}, STRUCT(FLATTEN_JSON AS flatten_json_output, OUTPUT_DIMENSIONALITY AS output_dimensionality) );

Sostituisci quanto segue:

PROJECT_ID: il tuo ID progetto.DATASET_ID: l'ID del set di dati che contiene il modello.MODEL_NAME: il nome del modello remoto su un modellomultimodalembedding@001.TABLE_NAME: il nome della tabella che contiene il testo da incorporare. Questa tabella deve avere una colonna denominatacontentoppure puoi utilizzare un alias per utilizzare una colonna con un nome diverso.CONTENT_QUERY: una query il cui risultato contiene una colonnaSTRINGdenominatacontent.FLATTEN_JSON: unBOOLche indica se analizzare l'embedding in una colonna separata. Il valore predefinito èTRUE.OUTPUT_DIMENSIONALITY: un valoreINT64che specifica il numero di dimensioni da utilizzare per generare gli incorporamenti. I valori validi sono128,256,512e1408. Il valore predefinito è1408. Ad esempio, se specifichi256 AS output_dimensionality, la colonna di outputml_generate_embedding_resultcontiene 256 incorporamenti per ogni valore di input.

Esempio: utilizza gli incorporamenti per classificare la similarità semantica

L'esempio seguente incorpora una raccolta di recensioni di film e le ordina in base alla

distanza del coseno dalla recensione "Questo film era nella media" utilizzando la funzione VECTOR_SEARCH.

Una distanza più breve indica una maggiore somiglianza semantica.

Per saperne di più sulla ricerca vettoriale e sull'indice vettoriale, consulta la pagina Introduzione alla ricerca vettoriale.

CREATE TEMPORARY TABLE movie_review_embeddings AS ( SELECT * FROM ML.GENERATE_EMBEDDING( MODEL `bqml_tutorial.embedding_model`, ( SELECT "This movie was fantastic" AS content UNION ALL SELECT "This was the best movie I've ever seen!!" AS content UNION ALL SELECT "This movie was just okay..." AS content UNION ALL SELECT "This movie was terrible." AS content ), STRUCT(TRUE AS flatten_json_output) ) ); WITH average_review_embedding AS ( SELECT ml_generate_embedding_result FROM ML.GENERATE_EMBEDDING( MODEL `bqml_tutorial.embedding_model`, (SELECT "This movie was average" AS content), STRUCT(TRUE AS flatten_json_output) ) ) SELECT base.content AS content, distance AS distance_to_average_review FROM VECTOR_SEARCH( TABLE movie_review_embeddings, "ml_generate_embedding_result", (SELECT ml_generate_embedding_result FROM average_review_embedding), distance_type=>"COSINE", top_k=>-1 ) ORDER BY distance_to_average_review;

Il risultato è il seguente:

+------------------------------------------+----------------------------+ | content | distance_to_average_review | +------------------------------------------+----------------------------+ | This movie was just okay... | 0.062789813467745592 | | This movie was fantastic | 0.18579561313064263 | | This movie was terrible. | 0.35707466240930985 | | This was the best movie I've ever seen!! | 0.41844932504542975 | +------------------------------------------+----------------------------+

Passaggi successivi

- Scopri come utilizzare gli incorporamenti di testo e immagini per eseguire una ricerca semantica da testo a immagine.

- Scopri come utilizzare i text embedding per la ricerca semantica e la Retrieval Augmented Generation (RAG).