Transcribir archivos de audio con la función ML.TRANSCRIBE

En este documento se describe cómo usar la ML.TRANSCRIBEfunción con un modelo remoto para transcribir archivos de audio de una tabla de objetos.

Ubicaciones admitidas

Debes crear el modelo remoto que se usa en este procedimiento en una de las siguientes ubicaciones:

asia-northeast1asia-south1asia-southeast1australia-southeast1eueurope-west1europe-west2europe-west3europe-west4northamerica-northeast1usus-central1us-east1us-east4us-west1

Debes ejecutar la función ML.TRANSCRIBE en la misma región que el modelo remoto.

Roles obligatorios

Para crear un modelo remoto y transcribir archivos de audio, necesitas los siguientes roles de Gestión de Identidades y Accesos (IAM) a nivel de proyecto:

- Crear un reconocedor de voz: editor de Cloud Speech

(

roles/speech.editor) - Crear y usar conjuntos de datos, tablas y modelos de BigQuery:

Editor de datos de BigQuery (

roles/bigquery.dataEditor) Crear, delegar y usar conexiones de BigQuery: Administrador de conexión de BigQuery (

roles/bigquery.connectionsAdmin)Si no tiene configurada una conexión predeterminada, puede crear una y definirla al ejecutar la instrucción

CREATE MODEL. Para ello, debes tener el rol Administrador de BigQuery (roles/bigquery.admin) en tu proyecto. Para obtener más información, consulta Configurar la conexión predeterminada.Concede permisos a la cuenta de servicio de la conexión: administrador de gestión de identidades y accesos del proyecto (

roles/resourcemanager.projectIamAdmin).Crear tareas de BigQuery: usuario de tareas de BigQuery (

roles/bigquery.jobUser)

Estos roles predefinidos contienen los permisos necesarios para realizar las tareas descritas en este documento. Para ver los permisos exactos que se necesitan, despliega la sección Permisos necesarios:

Permisos obligatorios

- Crea un conjunto de datos:

bigquery.datasets.create - Crea, delega y usa una conexión:

bigquery.connections.* - Define los permisos de la cuenta de servicio:

resourcemanager.projects.getIamPolicyyresourcemanager.projects.setIamPolicy - Crea un modelo y ejecuta la inferencia:

bigquery.jobs.createbigquery.models.createbigquery.models.getDatabigquery.models.updateDatabigquery.models.updateMetadata

- Crea una tabla de objetos:

bigquery.tables.createybigquery.tables.update - Crea un reconocedor de voz:

speech.recognizers.createspeech.recognizers.getspeech.recognizers.recognizespeech.recognizers.update

También puedes obtener estos permisos con roles personalizados u otros roles predefinidos.

Antes de empezar

- Sign in to your Google Cloud account. If you're new to Google Cloud, create an account to evaluate how our products perform in real-world scenarios. New customers also get $300 in free credits to run, test, and deploy workloads.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the BigQuery, BigQuery Connection API, and Speech-to-Text APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles. -

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the BigQuery, BigQuery Connection API, and Speech-to-Text APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles. En la Google Cloud consola, ve a la página BigQuery.

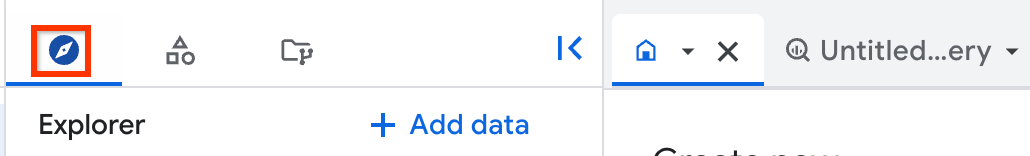

En el panel de la izquierda, haz clic en Explorador:

Si no ves el panel de la izquierda, haz clic en Ampliar panel de la izquierda para abrirlo.

En el panel Explorador, haz clic en el nombre de tu proyecto.

Haz clic en Ver acciones > Crear conjunto de datos.

En la página Crear conjunto de datos, haz lo siguiente:

En ID del conjunto de datos, escribe un nombre para el conjunto de datos.

En Tipo de ubicación, selecciona Región o Multirregión.

- Si has seleccionado Región, elige una ubicación de la lista Región.

- Si has seleccionado Multirregión, elige EE. UU. o Europa en la lista Multirregión.

Haz clic en Crear conjunto de datos.

Para crear un conjunto de datos, usa el comando

bq mkcon la marca--location:bq --location=LOCATION mk -d DATASET_ID

Haz los cambios siguientes:

LOCATION: la ubicación del conjunto de datos.DATASET_IDes el ID del conjunto de datos que vas a crear.

Confirma que se ha creado el conjunto de datos:

bq lsVe a la página BigQuery.

En el panel Explorador, haga clic en Añadir datos:

Se abrirá el cuadro de diálogo Añadir datos.

En el panel Filtrar por, en la sección Tipo de fuente de datos, selecciona Aplicaciones empresariales.

También puede introducir

Vertex AIen el campo Buscar fuentes de datos.En la sección Fuentes de datos destacadas, haga clic en Vertex AI.

Haz clic en la tarjeta de solución Modelos de Vertex AI: federación de BigQuery.

En la lista Tipo de conexión, selecciona Modelos remotos y funciones remotas de Vertex AI, BigLake y Spanner (recurso de Cloud).

En el campo ID de conexión, introduce un nombre para la conexión.

Haga clic en Crear conexión.

Haz clic en Ir a la conexión.

En el panel Información de conexión, copia el ID de la cuenta de servicio para usarlo en un paso posterior.

En un entorno de línea de comandos, crea una conexión:

bq mk --connection --location=REGION --project_id=PROJECT_ID \ --connection_type=CLOUD_RESOURCE CONNECTION_ID

El parámetro

--project_idanula el proyecto predeterminado.Haz los cambios siguientes:

REGION: tu región de conexiónPROJECT_ID: tu ID de proyecto Google CloudCONNECTION_ID: un ID para tu conexión

Cuando creas un recurso de conexión, BigQuery crea una cuenta de servicio del sistema única y la asocia a la conexión.

Solución de problemas: si aparece el siguiente error de conexión, actualiza el SDK de Google Cloud:

Flags parsing error: flag --connection_type=CLOUD_RESOURCE: value should be one of...

Obtén y copia el ID de la cuenta de servicio para usarlo en un paso posterior:

bq show --connection PROJECT_ID.REGION.CONNECTION_ID

El resultado debería ser similar al siguiente:

name properties 1234.REGION.CONNECTION_ID {"serviceAccountId": "connection-1234-9u56h9@gcp-sa-bigquery-condel.iam.gserviceaccount.com"}- Abre Cloud Shell.

-

Define el Google Cloud proyecto predeterminado en el que quieras aplicar tus configuraciones de Terraform.

Solo tiene que ejecutar este comando una vez por proyecto y puede hacerlo en cualquier directorio.

export GOOGLE_CLOUD_PROJECT=PROJECT_ID

Las variables de entorno se anulan si defines valores explícitos en el archivo de configuración de Terraform.

-

En Cloud Shell, crea un directorio y un archivo nuevo en ese directorio. El nombre del archivo debe tener la extensión

.tf. Por ejemplo,main.tf. En este tutorial, nos referiremos al archivo comomain.tf.mkdir DIRECTORY && cd DIRECTORY && touch main.tf

-

Si estás siguiendo un tutorial, puedes copiar el código de ejemplo de cada sección o paso.

Copia el código de ejemplo en el archivo

main.tfque acabas de crear.También puedes copiar el código de GitHub. Se recomienda cuando el fragmento de Terraform forma parte de una solución integral.

- Revisa y modifica los parámetros de ejemplo para aplicarlos a tu entorno.

- Guarda los cambios.

-

Inicializa Terraform. Solo tienes que hacerlo una vez por directorio.

terraform init

Si quieres usar la versión más reciente del proveedor de Google, incluye la opción

-upgrade:terraform init -upgrade

-

Revisa la configuración y comprueba que los recursos que va a crear o actualizar Terraform se ajustan a tus expectativas:

terraform plan

Haga las correcciones necesarias en la configuración.

-

Aplica la configuración de Terraform ejecutando el siguiente comando e introduciendo

yesen la petición:terraform apply

Espera hasta que Terraform muestre el mensaje "Apply complete!".

- Abre tu Google Cloud proyecto para ver los resultados. En la Google Cloud consola, ve a tus recursos en la interfaz de usuario para asegurarte de que Terraform los ha creado o actualizado.

Ve a la página IAM y administración.

Haz clic en Conceder acceso.

Se abrirá el cuadro de diálogo Añadir principales.

En el campo Nuevos principales, introduce el ID de la cuenta de servicio que has copiado anteriormente.

Haz clic en el campo Selecciona un rol y, a continuación, escribe

Cloud Speech Clienten Filtrar.Haz clic en Añadir otro rol.

En el campo Selecciona un rol, elige Cloud Storage y, a continuación, Visor de objetos de Storage.

Haz clic en Guardar.

PROJECT_NUMBER: tu número de proyecto.MEMBER: el ID de la cuenta de servicio que has copiado anteriormente.PROJECT_ID: tu ID de proyecto.DATASET_ID: ID del conjunto de datos que contendrá el modelo.MODEL_NAME: el nombre del modelo.REGION: la región que usa la conexión.CONNECTION_ID: el ID de la conexión. Por ejemplo,myconnection.Cuando consultas los detalles de la conexión en la consola de Google Cloud , el ID de conexión es el valor de la última sección del ID de conexión completo que se muestra en ID de conexión, por ejemplo,

projects/myproject/locations/connection_location/connections/myconnection.PROJECT_NUMBER: el número de proyecto del proyecto que contiene el reconocedor de voz. Puedes encontrar este valor en la tarjeta Información del proyecto de la página Panel de control de la consola de Google Cloud .LOCATION: la ubicación que usa el reconocedor de voz. Puedes encontrar este valor en el campo Ubicación de la página Lista de reconocedores de la consola de Google Cloud .RECOGNIZER_ID: el ID del reconocedor de voz. Puede encontrar este valor en el campo ID de la página List recognizers (Lista de reconocedores) de la consola Google Cloud .Esta opción no es obligatoria. Si no especificas ningún valor, se usará un reconocedor predeterminado. En ese caso, debe especificar un valor para el parámetro

recognition_configde la funciónML.TRANSCRIBEpara proporcionar una configuración al reconocedor predeterminado.Solo puede usar el

chirpmodelo de transcripción en el valorrecognition_configque proporcione.PROJECT_ID: tu ID de proyecto.DATASET_ID: el ID del conjunto de datos que contiene el modelo.MODEL_NAME: el nombre del modelo.OBJECT_TABLE_NAME: el nombre de la tabla de objetos que contiene los URIs de los archivos de audio que se van a procesar.recognition_config: un recursoRecognitionConfigen formato JSON.Si se ha especificado un reconocedor para el modelo remoto mediante la opción

SPEECH_RECOGNIZER, no puedes especificar un valor derecognition_config.Si no se ha especificado ningún reconocedor para el modelo remoto mediante la opción

SPEECH_RECOGNIZER, debes especificar un valorrecognition_config. Este valor se usa para proporcionar una configuración al reconocedor predeterminado.Solo puede usar el

chirpmodelo de transcripción en el valorrecognition_configque proporcione.- Para obtener más información sobre la inferencia de modelos en BigQuery ML, consulta el resumen de la inferencia de modelos.

- Para obtener más información sobre cómo usar las APIs de IA de Cloud para realizar tareas de IA, consulta el artículo Descripción general de las aplicaciones de IA.

- Para obtener más información sobre las instrucciones y funciones de SQL admitidas en los modelos de IA generativa, consulta Recorridos de usuario completos de los modelos de IA generativa.

Crear un reconocedor

Speech-to-Text admite recursos denominados reconocedores. Los reconocedores representan configuraciones de reconocimiento almacenadas y reutilizables. Puedes crear un reconocedor para agrupar lógicamente las transcripciones o el tráfico de tu aplicación.

Crear un reconocedor de voz es opcional. Si decides crear un reconocedor de voz, anota el ID del proyecto, la ubicación y el ID del reconocedor para usarlos en la instrucción CREATE MODEL, tal como se describe en SPEECH_RECOGNIZER.

Si decides no crear un reconocedor de voz, debes especificar un valor

para el argumento recognition_config

de la función ML.TRANSCRIBE.

Solo puedes usar el chirp

modelo de transcripción

en el reconocedor de voz o el valor recognition_config que proporciones.

Crear conjunto de datos

Crea un conjunto de datos de BigQuery para que contenga tus recursos:

Consola

bq

Crear una conexión

Puedes saltarte este paso si tienes una conexión predeterminada configurada o si tienes el rol Administrador de BigQuery.

Crea una conexión de recursos de Cloud para que la use el modelo remoto y obtén la cuenta de servicio de la conexión. Crea la conexión en la misma ubicación que el conjunto de datos que has creado en el paso anterior.

Selecciona una de las opciones siguientes:

Consola

bq

Terraform

Usa el recurso google_bigquery_connection.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Para obtener más información, consulta Configurar la autenticación para bibliotecas de cliente.

En el siguiente ejemplo se crea una conexión de recursos de Cloud llamada my_cloud_resource_connection en la región US:

Para aplicar la configuración de Terraform en un proyecto, sigue los pasos que se indican en las siguientes secciones. Google Cloud

Preparar Cloud Shell

Preparar el directorio

Cada archivo de configuración de Terraform debe tener su propio directorio (también llamado módulo raíz).

Aplica los cambios

Conceder acceso a la cuenta de servicio

Selecciona una de las opciones siguientes:

Consola

gcloud

Usa el comando gcloud projects add-iam-policy-binding:

gcloud projects add-iam-policy-binding 'PROJECT_NUMBER' --member='serviceAccount:MEMBER' --role='roles/speech.client' --condition=None gcloud projects add-iam-policy-binding 'PROJECT_NUMBER' --member='serviceAccount:MEMBER' --role='roles/storage.objectViewer' --condition=None

Haz los cambios siguientes:

Si no se concede el permiso, se producirá un error Permission denied.

Crear una tabla de objetos

Crea una tabla de objetos a partir de un conjunto de archivos de audio en Cloud Storage. Los archivos de audio de la tabla de objetos deben ser de un tipo admitido.

El segmento de Cloud Storage que usa la tabla de objetos debe estar en el mismo proyecto en el que tienes previsto crear el modelo y llamar a la función ML.TRANSCRIBE. Si quieres llamar a la función ML.TRANSCRIBE en un proyecto distinto del que contiene el segmento de Cloud Storage que usa la tabla de objetos, debes conceder el rol Administrador de almacenamiento a nivel de segmento a la cuenta de servicio service-A@gcp-sa-aiplatform.iam.gserviceaccount.com.

Crear un modelo

Crea un modelo remoto con un

REMOTE_SERVICE_TYPE de

CLOUD_AI_SPEECH_TO_TEXT_V2:

CREATE OR REPLACE MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME` REMOTE WITH CONNECTION {DEFAULT | `PROJECT_ID.REGION.CONNECTION_ID`} OPTIONS ( REMOTE_SERVICE_TYPE = 'CLOUD_AI_SPEECH_TO_TEXT_V2', SPEECH_RECOGNIZER = 'projects/PROJECT_NUMBER/locations/LOCATION/recognizers/RECOGNIZER_ID' );

Haz los cambios siguientes:

Transcribir archivos de audio

Transcribir archivos de audio con la función ML.TRANSCRIBE:

SELECT * FROM ML.TRANSCRIBE( MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME`, TABLE `PROJECT_ID.DATASET_ID.OBJECT_TABLE_NAME`, RECOGNITION_CONFIG => ( JSON 'recognition_config') );

Haz los cambios siguientes:

Ejemplos

Ejemplo 1

En el siguiente ejemplo se transcriben los archivos de audio representados por la tabla audio sin anular la configuración predeterminada del reconocedor:

SELECT * FROM ML.TRANSCRIBE( MODEL `myproject.mydataset.transcribe_model`, TABLE `myproject.mydataset.audio` );

En el siguiente ejemplo se transcriben los archivos de audio representados por la tabla audio y se proporciona una configuración para el reconocedor predeterminado:

SELECT * FROM ML.TRANSCRIBE( MODEL `myproject.mydataset.transcribe_model`, TABLE `myproject.mydataset.audio`, recognition_config => ( JSON '{"language_codes": ["en-US" ],"model": "chirp","auto_decoding_config": {}}') );