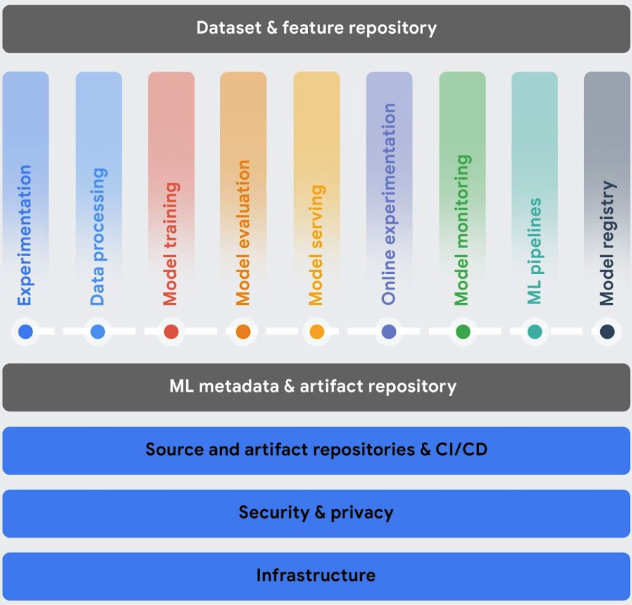

Bagian ini menjelaskan layanan Vertex AI yang membantu Anda menerapkan Operasi machine learning (MLOps) dengan alur kerja machine learning (ML) Anda.

Setelah di-deploy, model tersebut harus mengikuti perubahan data dari lingkungan agar dapat berperforma optimal dan tetap relevan. MLOps adalah serangkaian praktik yang meningkatkan stabilitas dan keandalan sistem ML Anda.

Alat Vertex AI MLOps membantu Anda berkolaborasi di seluruh tim AI dan meningkatkan model melalui pemantauan model prediktif, pemberitahuan, diagnosis, dan penjelasan yang dapat ditindaklanjuti. Semua alat ini bersifat modular, sehingga Anda dapat mengintegrasikannya ke dalam sistem yang ada sesuai kebutuhan.

Untuk mengetahui informasi selengkapnya tentang MLOps, lihat Pipeline otomatisasi dan continuous delivery di machine learning serta Panduan Praktisi untuk MLOps.

Mengorkestrasi alur kerja: Melatih dan menyajikan model secara manual dapat memakan waktu dan rentan error, terutama jika Anda perlu mengulangi proses ini berkali-kali.

- Vertex AI Pipelines membantu Anda mengotomatiskan, memantau, dan mengatur alur kerja ML Anda.

Melacak metadata yang digunakan dalam sistem ML: Dalam data science, penting untuk melacak parameter, artefak, dan metrik yang digunakan dalam alur kerja ML Anda, terutama saat Anda mengulangi alur kerja tersebut berulang kali.

- Vertex ML Metadata memungkinkan Anda merekam metadata, parameter, dan artefak yang digunakan dalam sistem ML Anda. Selanjutnya, Anda dapat membuat kueri metadata tersebut untuk membantu menganalisis, men-debug, dan mengaudit performa sistem ML Anda atau artefak yang dihasilkannya.

Identifikasi model terbaik untuk kasus penggunaan: Saat mencoba algoritma pelatihan baru, Anda perlu mengetahui model terlatih mana yang memiliki performa terbaik.

Vertex AI Experiments memungkinkan Anda melacak dan menganalisis berbagai arsitektur model, hyper-parameter, dan lingkungan pelatihan untuk mengidentifikasi model terbaik untuk kasus penggunaan Anda.

Vertex AI TensorBoard membantu Anda melacak, memvisualisasikan, dan membandingkan eksperimen ML untuk mengukur performa model Anda.

Mengelola versi model: Menambahkan model ke repositori pusat membantu Anda memantau versi model.

- Vertex AI Model Registry memberikan ringkasan model sehingga Anda dapat mengatur, melacak, dan melatih versi baru dengan lebih baik. Dari Model Registry, Anda dapat mengevaluasi model, men-deploy model ke endpoint, membuat inferensi batch, serta melihat detail tentang model dan versi model tertentu.

Mengelola fitur: Saat menggunakan kembali fitur ML di beberapa tim, Anda memerlukan cara yang cepat dan efisien untuk membagikan dan menayangkan fitur.

- Vertex AI Feature Store menyediakan repositori terpusat untuk mengatur, menyimpan, dan menyalurkan fitur ML. Dengan menggunakan fitur ML, organisasi dapat menggunakan kembali fitur ML dalam skala besar dan meningkatkan kecepatan pengembangan serta deployment aplikasi ML baru.

Memantau kualitas model: Model yang di-deploy dalam produksi memiliki performa terbaik pada data input inferensi yang mirip dengan data pelatihan. Saat data input menyimpang dari data yang digunakan untuk melatih model, performa model dapat menurun, meskipun model itu sendiri belum berubah.

- Vertex AI Model Monitoring memantau model untuk mencari diferensiasi performa pelatihan dan penayangan serta penyimpangan inferensi, lalu mengirimi Anda pemberitahuan saat data inferensi yang masuk menyimpang terlalu jauh dari dasar pengukuran pelatihan. Anda dapat menggunakan pemberitahuan dan distribusi fitur untuk mengevaluasi apakah Anda perlu melatih ulang model.

Menskalakan aplikasi AI dan Python: Ray adalah framework open source untuk menskalakan aplikasi AI dan Python. Ray menyediakan infrastruktur untuk melakukan komputasi terdistribusi dan pemrosesan paralel untuk alur kerja machine learning (ML) Anda.

- Ray di Vertex AI dirancang agar Anda dapat menggunakan kode Ray open source yang sama untuk menulis program dan mengembangkan aplikasi di Vertex AI dengan sedikit perubahan. Selanjutnya, Anda dapat menggunakan integrasi Vertex AI dengan layanan Google Cloud lain seperti Inferensi Vertex AI dan BigQuery sebagai bagian dari alur kerja machine learning (ML) Anda.