Halaman ini menjelaskan cara menyisipkan objek ke dalam gambar, yang juga disebut inpainting. Imagen di Vertex AI memungkinkan Anda menentukan area mask untuk menyisipkan objek ke dalam gambar. Anda dapat menggunakan mask Anda sendiri, atau Anda dapat membiarkan Imagen di Vertex AI membuat mask untuk Anda.

Contoh penyisipan konten

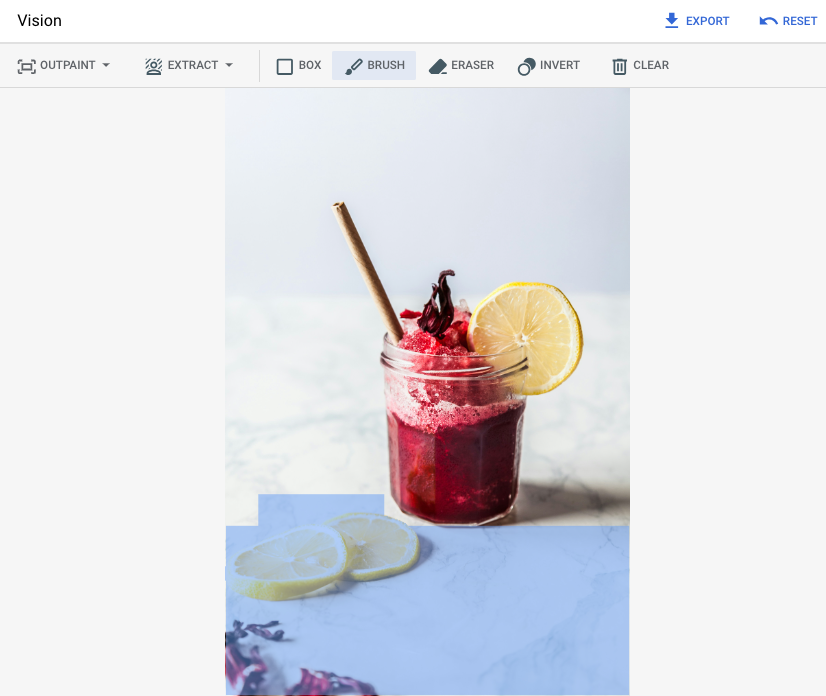

Dengan inpainting untuk menyisipkan konten, Anda dapat menggunakan gambar dasar, mask gambar, dan perintah teks untuk menambahkan konten ke gambar yang ada.

Input

| Gambar dasar* yang akan diedit | Area mask yang ditentukan menggunakan alat di konsol Google Cloud | Perintah teks |

|---|---|---|

|

|

stroberi |

* Kredit gambar: Alex Lvrs di Unsplash.

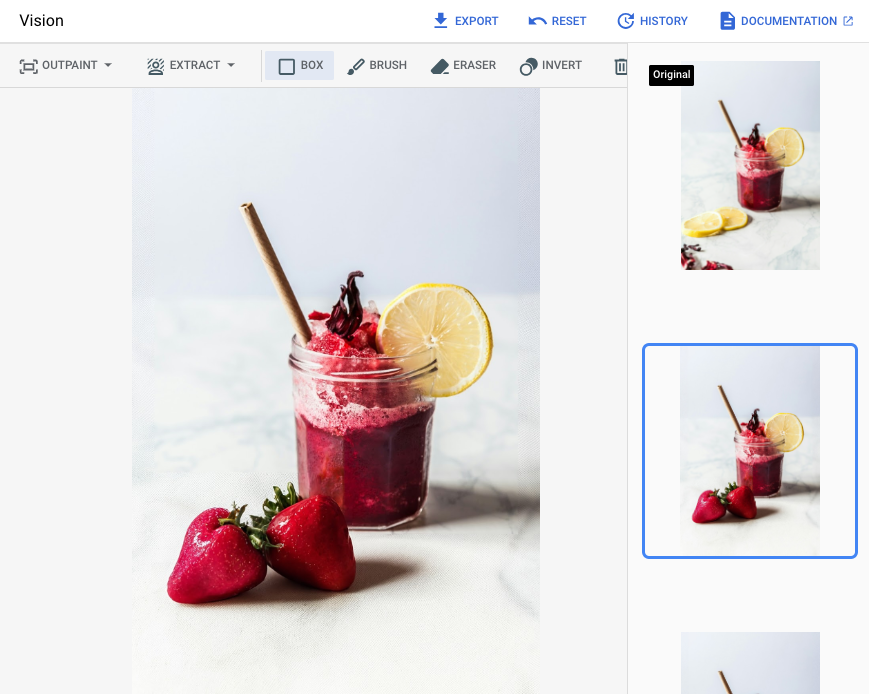

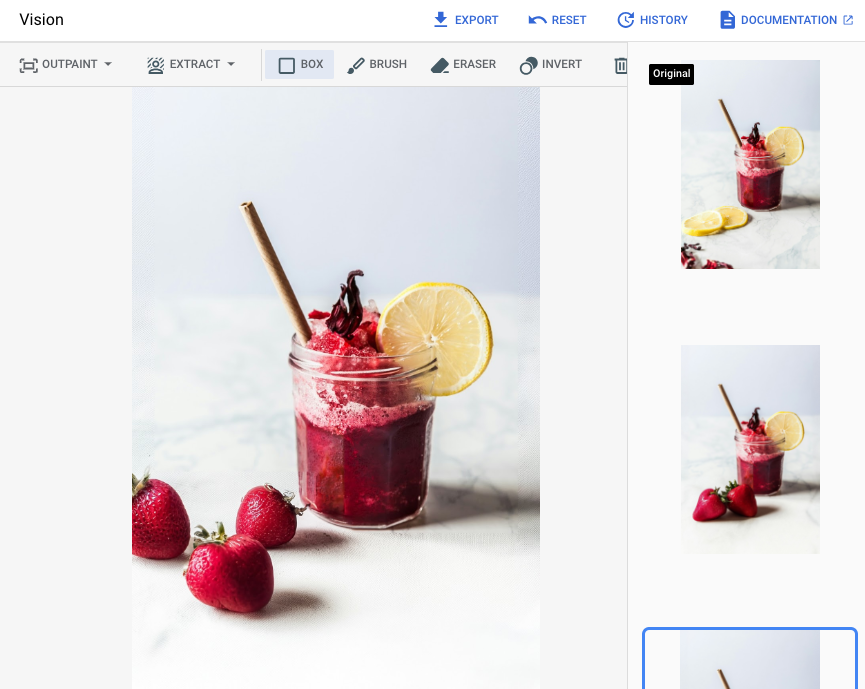

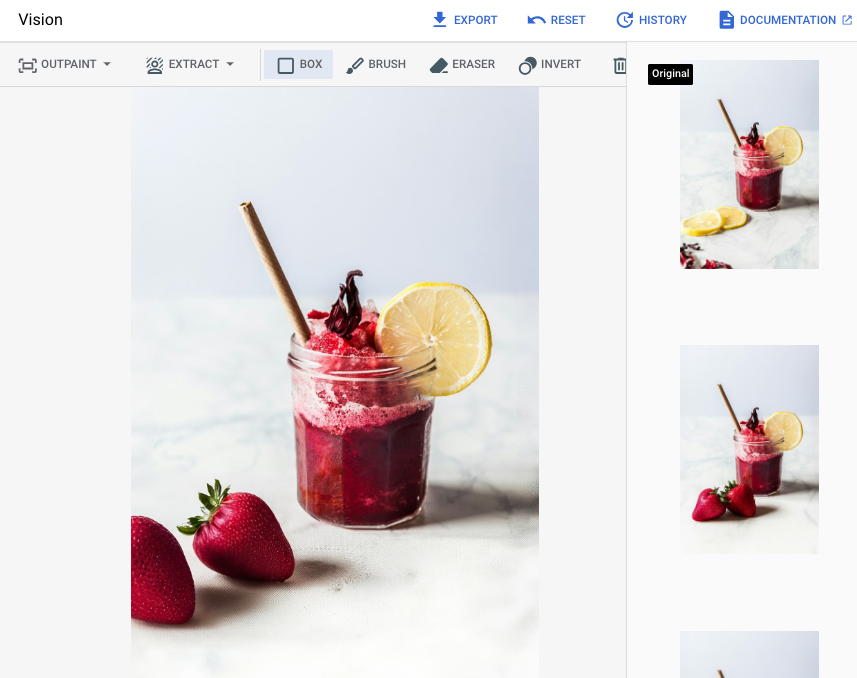

Output setelah menentukan area mask di konsol Google Cloud

|

|

|

Melihat kartu model Imagen untuk Pengeditan dan Penyesuaian

Sebelum memulai

- Sign in to your Google Cloud account. If you're new to Google Cloud, create an account to evaluate how our products perform in real-world scenarios. New customers also get $300 in free credits to run, test, and deploy workloads.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the Vertex AI API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles. -

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the Vertex AI API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles. -

Siapkan autentikasi untuk lingkungan Anda.

Select the tab for how you plan to use the samples on this page:

Console

When you use the Google Cloud console to access Google Cloud services and APIs, you don't need to set up authentication.

Java

Untuk menggunakan contoh Java di halaman ini dalam lingkungan pengembangan lokal, instal dan lakukan inisialisasi gcloud CLI, lalu siapkan Kredensial Default Aplikasi dengan kredensial pengguna Anda.

Menginstal Google Cloud CLI.

Jika Anda menggunakan penyedia identitas (IdP) eksternal, Anda harus login ke gcloud CLI dengan identitas gabungan Anda terlebih dahulu.

If you're using a local shell, then create local authentication credentials for your user account:

gcloud auth application-default login

You don't need to do this if you're using Cloud Shell.

If an authentication error is returned, and you are using an external identity provider (IdP), confirm that you have signed in to the gcloud CLI with your federated identity.

Untuk mengetahui informasi selengkapnya, lihat Menyiapkan ADC untuk lingkungan pengembangan lokal dalam dokumentasi autentikasi Google Cloud .

Node.js

Untuk menggunakan contoh Node.js di halaman ini dalam lingkungan pengembangan lokal, instal dan lakukan inisialisasi gcloud CLI, lalu siapkan Kredensial Default Aplikasi dengan kredensial pengguna Anda.

Menginstal Google Cloud CLI.

Jika Anda menggunakan penyedia identitas (IdP) eksternal, Anda harus login ke gcloud CLI dengan identitas gabungan Anda terlebih dahulu.

If you're using a local shell, then create local authentication credentials for your user account:

gcloud auth application-default login

You don't need to do this if you're using Cloud Shell.

If an authentication error is returned, and you are using an external identity provider (IdP), confirm that you have signed in to the gcloud CLI with your federated identity.

Untuk mengetahui informasi selengkapnya, lihat Menyiapkan ADC untuk lingkungan pengembangan lokal dalam dokumentasi autentikasi Google Cloud .

Python

Untuk menggunakan contoh Python di halaman ini dalam lingkungan pengembangan lokal, instal dan lakukan inisialisasi gcloud CLI, lalu siapkan Kredensial Default Aplikasi dengan kredensial pengguna Anda.

Menginstal Google Cloud CLI.

Jika Anda menggunakan penyedia identitas (IdP) eksternal, Anda harus login ke gcloud CLI dengan identitas gabungan Anda terlebih dahulu.

If you're using a local shell, then create local authentication credentials for your user account:

gcloud auth application-default login

You don't need to do this if you're using Cloud Shell.

If an authentication error is returned, and you are using an external identity provider (IdP), confirm that you have signed in to the gcloud CLI with your federated identity.

Untuk mengetahui informasi selengkapnya, lihat Menyiapkan ADC untuk lingkungan pengembangan lokal dalam dokumentasi autentikasi Google Cloud .

REST

Untuk menggunakan contoh REST API di halaman ini dalam lingkungan pengembangan lokal, Anda menggunakan kredensial yang Anda berikan ke gcloud CLI.

Menginstal Google Cloud CLI.

Jika Anda menggunakan penyedia identitas (IdP) eksternal, Anda harus login ke gcloud CLI dengan identitas gabungan Anda terlebih dahulu.

Untuk mengetahui informasi selengkapnya, lihat Melakukan autentikasi untuk menggunakan REST dalam dokumentasi autentikasi Google Cloud .

Menyisipkan dengan area mask yang ditentukan

Gunakan contoh berikut untuk menentukan inpainting guna menyisipkan konten. Dalam contoh ini, Anda menentukan gambar dasar, perintah teks, dan area mask untuk mengubah gambar dasar.

Imagen 3

Gunakan contoh berikut untuk mengirim permintaan inpainting menggunakan model Imagen 3.

Konsol

-

Di Google Cloud konsol, buka halaman Vertex AI > Media Studio .

- Klik Upload. Di dialog file yang ditampilkan, pilih file yang akan diupload.

- Klik Perbaiki.

-

Lakukan salah satu hal berikut:

- Mengupload masker Anda sendiri:

- Buat masker di komputer Anda.

- Klik Upload mask. Pada dialog yang ditampilkan, pilih mask yang akan diupload.

- Tentukan mask Anda: di toolbar pengeditan, gunakan alat mask (kotak, kuas, atau alat inversi masked_transitions) untuk menentukan area yang akan ditambahi konten.

- Mengupload masker Anda sendiri:

-

Opsional: Di panel Parameters, sesuaikan opsi berikut:

- Model: model Imagen yang akan digunakan

- Jumlah hasil: jumlah hasil yang akan dibuat

- Perintah negatif: item yang harus dihindari saat membuat gambar

- Pada kolom perintah, masukkan perintah untuk mengubah gambar.

- Klik Generate.

Python

Instal

pip install --upgrade google-genai

Untuk mempelajari lebih lanjut, lihat dokumentasi referensi SDK.

Tetapkan variabel lingkungan untuk menggunakan Gen AI SDK dengan Vertex AI:

# Replace the `GOOGLE_CLOUD_PROJECT` and `GOOGLE_CLOUD_LOCATION` values # with appropriate values for your project. export GOOGLE_CLOUD_PROJECT=GOOGLE_CLOUD_PROJECT export GOOGLE_CLOUD_LOCATION=us-central1 export GOOGLE_GENAI_USE_VERTEXAI=True

REST

Untuk mengetahui informasi selengkapnya, lihat referensi API Edit gambar.

Sebelum menggunakan salah satu data permintaan, lakukan penggantian berikut:

- PROJECT_ID: Google Cloud Project ID Anda.

- LOCATION: Region project Anda. Misalnya,

us-central1,europe-west2, atauasia-northeast3. Untuk mengetahui daftar region yang tersedia, lihat Lokasi AI Generatif di Vertex AI. - TEXT_PROMPT: Perintah teks memandu gambar yang dihasilkan model. Saat Anda menggunakan perintah untuk penyisipan inpainting, gunakan deskripsi area yang diberi mask untuk mendapatkan hasil terbaik. Hindari perintah satu kata. Misalnya, gunakan "corgi lucu" bukan "corgi".

- B64_BASE_IMAGE: Gambar dasar yang akan diedit atau di-upscale. Gambar harus ditentukan sebagai string byte berenkode base64. Batas ukuran: 10 MB.

- B64_MASK_IMAGE: Gambar hitam putih yang ingin Anda gunakan sebagai lapisan mask untuk mengedit gambar asli. Gambar harus ditentukan sebagai string byte berenkode base64. Batas ukuran: 10 MB.

- MASK_DILATION - float. Persentase lebar gambar untuk memperlebar masker ini. Nilai

0.01direkomendasikan untuk mengompensasi mask input yang tidak sempurna. - EDIT_STEPS - bilangan bulat. Jumlah langkah pengambilan sampel untuk model dasar. Untuk penyisipan inpainting, mulai dari

35langkah. Tingkatkan langkah ke batas atas75jika kualitas tidak memenuhi persyaratan Anda. Meningkatkan langkah juga akan meningkatkan latensi permintaan. - EDIT_IMAGE_COUNT - Jumlah gambar yang diedit. Nilai bilangan bulat yang diterima: 1-4. Nilai default: 4.

Metode HTTP dan URL:

POST https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagen-3.0-capability-001:predict

Isi JSON permintaan:

{ "instances": [ { "prompt": "TEXT_PROMPT", "referenceImages": [ { "referenceType": "REFERENCE_TYPE_RAW", "referenceId": 1, "referenceImage": { "bytesBase64Encoded": "B64_BASE_IMAGE" } }, { "referenceType": "REFERENCE_TYPE_MASK", "referenceId": 2, "referenceImage": { "bytesBase64Encoded": "B64_MASK_IMAGE" }, "maskImageConfig": { "maskMode": "MASK_MODE_USER_PROVIDED", "dilation": MASK_DILATION } } ] } ], "parameters": { "editConfig": { "baseSteps": EDIT_STEPS }, "editMode": "EDIT_MODE_INPAINT_INSERTION", "sampleCount": EDIT_IMAGE_COUNT } }Untuk mengirim permintaan Anda, pilih salah satu opsi berikut:

Contoh respons berikut adalah untuk permintaan dengancurl

Simpan isi permintaan dalam file bernama

request.json, dan jalankan perintah berikut:curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagen-3.0-capability-001:predict"PowerShell

Simpan isi permintaan dalam file bernama

request.json, dan jalankan perintah berikut:$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagen-3.0-capability-001:predict" | Select-Object -Expand Content"sampleCount": 2. Respons ini menampilkan dua objek prediksi, dengan byte gambar yang dihasilkan berenkode base64.{ "predictions": [ { "bytesBase64Encoded": "BASE64_IMG_BYTES", "mimeType": "image/png" }, { "mimeType": "image/png", "bytesBase64Encoded": "BASE64_IMG_BYTES" } ] }Imagen 2

Gunakan contoh berikut untuk mengirim permintaan inpainting menggunakan model Imagen 2.

Konsol

-

Di Google Cloud konsol, buka halaman Vertex AI > Media Studio .

- Klik Upload. Di dialog file yang ditampilkan, pilih file yang akan diupload.

- Klik Perbaiki.

-

Lakukan salah satu hal berikut:

- Mengupload masker Anda sendiri:

- Buat masker di komputer Anda.

- Klik Upload mask. Pada dialog yang ditampilkan, pilih mask yang akan diupload.

- Tentukan mask Anda: di toolbar pengeditan, gunakan alat mask (kotak, kuas, atau alat inversi masked_transitions) untuk menentukan area yang akan ditambahi konten.

- Mengupload masker Anda sendiri:

-

Opsional. Di panel Parameter, sesuaikan opsi

berikut:

- Model: model Imagen yang akan digunakan

- Jumlah hasil: jumlah hasil yang akan dibuat

- Perintah negatif: item yang harus dihindari saat membuat gambar

- Pada kolom perintah, masukkan perintah baru untuk mengubah gambar.

- Klik Generate.

Python

Untuk mempelajari cara menginstal atau mengupdate Vertex AI SDK untuk Python, lihat Menginstal Vertex AI SDK untuk Python. Untuk mengetahui informasi selengkapnya, lihat dokumentasi referensi API Python.

REST

Untuk mengetahui informasi selengkapnya tentang permintaan model

imagegeneration, lihat referensi API modelimagegeneration.Sebelum menggunakan salah satu data permintaan, lakukan penggantian berikut:

- PROJECT_ID: Google Cloud Project ID Anda.

- LOCATION: Region project Anda. Misalnya,

us-central1,europe-west2, atauasia-northeast3. Untuk mengetahui daftar region yang tersedia, lihat Lokasi AI Generatif di Vertex AI. - TEXT_PROMPT: Perintah teks yang memandu gambar yang dihasilkan model. Kolom ini wajib diisi untuk pembuatan dan pengeditan.

- B64_BASE_IMAGE: Gambar dasar yang akan diedit atau di-upscale. Gambar harus ditentukan sebagai string byte berenkode base64. Batas ukuran: 10 MB.

- B64_MASK_IMAGE: Gambar hitam putih yang ingin Anda gunakan sebagai lapisan mask untuk mengedit gambar asli. Gambar harus ditentukan sebagai string byte berenkode base64. Batas ukuran: 10 MB.

- EDIT_IMAGE_COUNT: Jumlah gambar yang diedit. Nilai default: 4.

- GUIDANCE_SCALE_VALUE: Parameter (bilangan bulat) yang mengontrol

seberapa besar model mematuhi perintah teks. Nilai yang lebih besar akan meningkatkan keselarasan antara perintah

teks dan gambar yang dihasilkan, tetapi dapat mengurangi kualitas gambar. Nilai:

0-500. Default:60.

Metode HTTP dan URL:

POST https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagegeneration@006:predict

Isi JSON permintaan:

{ "instances": [ { "prompt": "TEXT_PROMPT", "image": { "bytesBase64Encoded": "B64_BASE_IMAGE" }, "mask": { "image": { "bytesBase64Encoded": "B64_MASK_IMAGE" } } } ], "parameters": { "sampleCount": EDIT_IMAGE_COUNT, "editConfig": { "editMode": "inpainting-insert", "guidanceScale": GUIDANCE_SCALE_VALUE } } }Untuk mengirim permintaan Anda, pilih salah satu opsi berikut:

Contoh respons berikut adalah untuk permintaan dengancurl

Simpan isi permintaan dalam file bernama

request.json, dan jalankan perintah berikut:curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagegeneration@006:predict"PowerShell

Simpan isi permintaan dalam file bernama

request.json, dan jalankan perintah berikut:$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagegeneration@006:predict" | Select-Object -Expand Content"sampleCount": 2. Respons ini menampilkan dua objek prediksi, dengan byte gambar yang dihasilkan berenkode base64.{ "predictions": [ { "bytesBase64Encoded": "BASE64_IMG_BYTES", "mimeType": "image/png" }, { "mimeType": "image/png", "bytesBase64Encoded": "BASE64_IMG_BYTES" } ] }Java

Sebelum mencoba contoh ini, ikuti petunjuk penyiapan Java di Panduan memulai Vertex AI menggunakan library klien. Untuk mengetahui informasi selengkapnya, lihat Dokumentasi referensi API Java Vertex AI.

Untuk melakukan autentikasi ke Vertex AI, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, lihat Menyiapkan autentikasi untuk lingkungan pengembangan lokal.

Dalam contoh ini, Anda menentukan model sebagai bagian dari

EndpointName.EndpointNamediteruskan ke metodepredictyang dipanggil diPredictionServiceClient. Layanan ini menampilkan versi gambar yang telah diedit, yang kemudian disimpan secara lokal.Untuk mengetahui informasi selengkapnya tentang versi dan fitur model, lihat Model Imagen.

Node.js

Sebelum mencoba contoh ini, ikuti petunjuk penyiapan Node.js di Panduan memulai Vertex AI menggunakan library klien. Untuk mengetahui informasi selengkapnya, lihat Dokumentasi referensi API Node.js Vertex AI.

Untuk melakukan autentikasi ke Vertex AI, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, lihat Menyiapkan autentikasi untuk lingkungan pengembangan lokal.

Dalam contoh ini, Anda memanggil metodepredictpadaPredictionServiceClient. Layanan ini menghasilkan gambar yang kemudian disimpan secara lokal. Untuk mengetahui informasi selengkapnya tentang versi dan fitur model, lihat Model Imagen.Menyisipkan dengan deteksi masker otomatis

Gunakan contoh berikut untuk menentukan inpainting guna menyisipkan konten. Dalam contoh ini, Anda menentukan gambar dasar dan perintah teks. Imagen secara otomatis mendeteksi dan membuat area mask untuk mengubah gambar dasar.

Imagen 3

Gunakan contoh berikut untuk mengirim permintaan inpainting menggunakan model Imagen 3.

Konsol

-

Di Google Cloud konsol, buka halaman Vertex AI > Media Studio .

- Klik Upload. Di dialog file yang ditampilkan, pilih file yang akan diupload.

- Klik Perbaiki.

- Di toolbar pengeditan, klik background_replaceEkstrak masker.

-

Pilih salah satu opsi ekstraksi mask:

- Elemen latar belakang: mendeteksi elemen latar belakang dan membuat masker di sekitarnya.

- Elemen latar depan: mendeteksi objek latar depan dan membuat mask di sekitarnya.

- background_replaceOrang: mendeteksi orang dan membuat mask di sekelilingnya.

-

Opsional: Di panel Parameters, sesuaikan opsi berikut:

- Model: model Imagen yang akan digunakan

- Jumlah hasil: jumlah hasil yang akan dibuat

- Perintah negatif: item yang harus dihindari saat membuat gambar

- Pada kolom perintah, masukkan perintah baru untuk mengubah gambar.

- Klik sendGenerate.

Python

Instal

pip install --upgrade google-genai

Untuk mempelajari lebih lanjut, lihat dokumentasi referensi SDK.

Tetapkan variabel lingkungan untuk menggunakan Gen AI SDK dengan Vertex AI:

# Replace the `GOOGLE_CLOUD_PROJECT` and `GOOGLE_CLOUD_LOCATION` values # with appropriate values for your project. export GOOGLE_CLOUD_PROJECT=GOOGLE_CLOUD_PROJECT export GOOGLE_CLOUD_LOCATION=us-central1 export GOOGLE_GENAI_USE_VERTEXAI=True

REST

Untuk mengetahui informasi selengkapnya, lihat referensi API Edit gambar.

Sebelum menggunakan salah satu data permintaan, lakukan penggantian berikut:

- PROJECT_ID: Google Cloud Project ID Anda.

- LOCATION: Region project Anda. Misalnya,

us-central1,europe-west2, atauasia-northeast3. Untuk mengetahui daftar region yang tersedia, lihat Lokasi AI Generatif di Vertex AI. - TEXT_PROMPT: Perintah teks memandu gambar yang dihasilkan model. Saat Anda menggunakan perintah untuk penyisipan inpainting, gunakan deskripsi area yang diberi mask untuk mendapatkan hasil terbaik. Hindari perintah satu kata. Misalnya, gunakan "corgi lucu" bukan "corgi".

- B64_BASE_IMAGE: Gambar dasar yang akan diedit atau di-upscale. Gambar harus ditentukan sebagai string byte berenkode base64. Batas ukuran: 10 MB.

- MASK_MODE - String yang menetapkan jenis pembuatan masker otomatis yang digunakan model.

Nilai yang tersedia:

MASK_MODE_BACKGROUND: Membuat mask secara otomatis menggunakan segmentasi latar belakang.MASK_MODE_FOREGROUND: Membuat mask secara otomatis menggunakan segmentasi latar depan.MASK_MODE_SEMANTIC: Secara otomatis membuat mask menggunakan segmentasi semantik berdasarkan segmentasi kelas yang Anda tentukan dalam arraymaskImageConfig.maskClasses. Contoh:"maskImageConfig": { "maskMode": "MASK_MODE_SEMANTIC", "maskClasses": [175, 176], // bicycle, car "dilation": 0.01 }

- MASK_DILATION - float. Persentase lebar gambar untuk memperlebar masker ini. Nilai

0.01direkomendasikan untuk mengompensasi mask input yang tidak sempurna. - EDIT_STEPS - bilangan bulat. Jumlah langkah pengambilan sampel untuk model dasar. Untuk penyisipan inpainting, mulai dari

35langkah. Tingkatkan langkah ke batas atas75jika kualitas tidak memenuhi persyaratan Anda. Meningkatkan langkah juga akan meningkatkan latensi permintaan. - EDIT_IMAGE_COUNT - Jumlah gambar yang diedit. Nilai bilangan bulat yang diterima: 1-4. Nilai default: 4.

Metode HTTP dan URL:

POST https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagen-3.0-capability-001:predict

Isi JSON permintaan:

{ "instances": [ { "prompt": "TEXT_PROMPT", "referenceImages": [ { "referenceType": "REFERENCE_TYPE_RAW", "referenceId": 1, "referenceImage": { "bytesBase64Encoded": "B64_BASE_IMAGE" } }, { "referenceType": "REFERENCE_TYPE_MASK", "referenceId": 2, "maskImageConfig": { "maskMode": "MASK_MODE", "dilation": MASK_DILATION } } ] } ], "parameters": { "editConfig": { "baseSteps": EDIT_STEPS }, "editMode": "EDIT_MODE_INPAINT_INSERTION", "sampleCount": EDIT_IMAGE_COUNT } }Untuk mengirim permintaan Anda, pilih salah satu opsi berikut:

Contoh respons berikut adalah untuk permintaan dengancurl

Simpan isi permintaan dalam file bernama

request.json, dan jalankan perintah berikut:curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagen-3.0-capability-001:predict"PowerShell

Simpan isi permintaan dalam file bernama

request.json, dan jalankan perintah berikut:$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagen-3.0-capability-001:predict" | Select-Object -Expand Content"sampleCount": 2. Respons ini menampilkan dua objek prediksi, dengan byte gambar yang dihasilkan berenkode base64.{ "predictions": [ { "bytesBase64Encoded": "BASE64_IMG_BYTES", "mimeType": "image/png" }, { "mimeType": "image/png", "bytesBase64Encoded": "BASE64_IMG_BYTES" } ] }Imagen 2

Gunakan contoh berikut untuk mengirim permintaan inpainting menggunakan model Imagen 2.

Konsol

-

Di Google Cloud konsol, buka halaman Vertex AI > Media Studio .

-

Di panel tugas di bagian bawah, klik Edit gambar.

-

Klik Upload untuk memilih gambar yang disimpan secara lokal yang akan diedit.

-

Di toolbar pengeditan, klik background_replaceEkstrak.

-

Pilih salah satu opsi ekstraksi mask:

- Elemen latar belakang - Mendeteksi elemen latar belakang dan membuat mask di sekitarnya.

- Elemen latar depan - Mendeteksi objek latar depan dan membuat mask di sekitarnya.

- background_replaceOrang - Mendeteksi orang dan membuat mask di sekitarnya.

-

Opsional: Di panel Parameters, sesuaikan Number of results, Negative prompt, Text prompt guidance, atau parameter lainnya.

-

Pada kolom perintah, masukkan perintah untuk mengubah gambar.

-

Klik Generate.

Python

Untuk mempelajari cara menginstal atau mengupdate Vertex AI SDK untuk Python, lihat Menginstal Vertex AI SDK untuk Python. Untuk mengetahui informasi selengkapnya, lihat dokumentasi referensi API Python.

REST

Untuk mengetahui informasi selengkapnya tentang permintaan model

imagegeneration, lihat referensi API modelimagegeneration.Sebelum menggunakan salah satu data permintaan, lakukan penggantian berikut:

- PROJECT_ID: Google Cloud Project ID Anda.

- LOCATION: Region project Anda. Misalnya,

us-central1,europe-west2, atauasia-northeast3. Untuk mengetahui daftar region yang tersedia, lihat Lokasi AI Generatif di Vertex AI. - TEXT_PROMPT: Perintah teks yang memandu gambar yang dihasilkan model. Kolom ini wajib diisi untuk pembuatan dan pengeditan.

- B64_BASE_IMAGE: Gambar dasar yang akan diedit atau di-upscale. Gambar harus ditentukan sebagai string byte berenkode base64. Batas ukuran: 10 MB.

- EDIT_IMAGE_COUNT: Jumlah gambar yang diedit. Nilai default: 4.

- MASK_TYPE: Mendorong model untuk membuat mask, sehingga Anda tidak perlu

memberikannya. Oleh karena itu, saat memberikan parameter ini, Anda harus menghilangkan objek

mask. Nilai yang tersedia:background: Membuat mask secara otomatis ke semua area kecuali objek, orang, atau subjek utama dalam gambar.foreground: Membuat mask secara otomatis untuk objek, orang, atau subjek utama dalam gambar.semantic: Gunakan segmentasi otomatis untuk membuat area mask untuk satu atau beberapa kelas segmentasi. Tetapkan class segmentasi menggunakan parameterclassesdan nilaiclass_idyang sesuai. Anda dapat menentukan hingga 5 kelas. Saat Anda menggunakan jenis masker semantik, objekmaskModeakan terlihat seperti berikut:"maskMode": { "maskType": "semantic", "classes": [class_id1, class_id2] }

- GUIDANCE_SCALE_VALUE: Parameter (bilangan bulat) yang mengontrol

seberapa besar model mematuhi perintah teks. Nilai yang lebih besar akan meningkatkan keselarasan antara perintah

teks dan gambar yang dihasilkan, tetapi dapat mengurangi kualitas gambar. Nilai:

0-500. Default:60.

Metode HTTP dan URL:

POST https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagegeneration@006:predict

Isi JSON permintaan:

{ "instances": [ { "prompt": "TEXT_PROMPT", "image": { "bytesBase64Encoded": "B64_BASE_IMAGE" } } ], "parameters": { "sampleCount": EDIT_IMAGE_COUNT, "editConfig": { "editMode": "inpainting-insert", "maskMode": { "maskType": "MASK_TYPE" }, "guidanceScale": GUIDANCE_SCALE_VALUE } } }Untuk mengirim permintaan Anda, pilih salah satu opsi berikut:

Contoh respons berikut adalah untuk permintaan dengancurl

Simpan isi permintaan dalam file bernama

request.json, dan jalankan perintah berikut:curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagegeneration@006:predict"PowerShell

Simpan isi permintaan dalam file bernama

request.json, dan jalankan perintah berikut:$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://LOCATION-aiplatform.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/publishers/google/models/imagegeneration@006:predict" | Select-Object -Expand Content"sampleCount": 2. Respons ini menampilkan dua objek prediksi, dengan byte gambar yang dihasilkan berenkode base64.{ "predictions": [ { "bytesBase64Encoded": "BASE64_IMG_BYTES", "mimeType": "image/png" }, { "mimeType": "image/png", "bytesBase64Encoded": "BASE64_IMG_BYTES" } ] }Batasan

Bagian berikut menjelaskan batasan fitur hapus objek Imagen.

Piksel yang dimodifikasi

Piksel yang dihasilkan oleh model yang tidak ada dalam mask tidak dijamin identik dengan input dan dihasilkan pada resolusi model (seperti 1024x1024). Perubahan yang sangat kecil mungkin ada pada gambar yang dihasilkan.

Jika Anda menginginkan pelestarian gambar yang sempurna, sebaiknya gabungkan gambar yang dihasilkan dengan gambar input, menggunakan mask. Biasanya, jika resolusi gambar input adalah 2K atau lebih tinggi, gambar yang dihasilkan dan gambar input harus digabungkan.

Masukkan batasan

Sisipan biasanya cocok dengan gaya gambar dasar. Namun, kata kunci tertentu dapat memicu output yang menyerupai gaya kartun, meskipun Anda ingin membuat output fotorealistik.

Salah satu contoh yang sering kami lihat adalah warna yang tidak akurat. Misalnya, "jerapah kuning" cenderung menghasilkan jerapah kartun, karena jerapah fotorealistis berwarna cokelat dan krem. Demikian pula, warna fotorealistik tetapi tidak alami sulit dibuat.

Langkah berikutnya

Baca artikel tentang Imagen dan produk AI Generatif lainnya di Vertex AI:

- Panduan developer untuk mulai menggunakan Imagen 3 di Vertex AI

- Model dan alat media generatif baru, yang dibuat dengan dan untuk kreator

- Baru di Gemini: Gem Kustom dan peningkatan pembuatan gambar dengan Imagen 3

- Google DeepMind: Imagen 3 - Model text-to-image berkualitas tertinggi kami

Kecuali dinyatakan lain, konten di halaman ini dilisensikan berdasarkan Lisensi Creative Commons Attribution 4.0, sedangkan contoh kode dilisensikan berdasarkan Lisensi Apache 2.0. Untuk mengetahui informasi selengkapnya, lihat Kebijakan Situs Google Developers. Java adalah merek dagang terdaftar dari Oracle dan/atau afiliasinya.

Terakhir diperbarui pada 2025-09-30 UTC.

-