Ao criar um pipeline de dados no Cloud Data Fusion, você usa uma série de fases, conhecidas como nós, para mover e gerenciar dados à medida que eles fluem da origem para o coletor. Cada nó consiste em um plug-in, um módulo personalizável que amplia os recursos do Cloud Data Fusion.

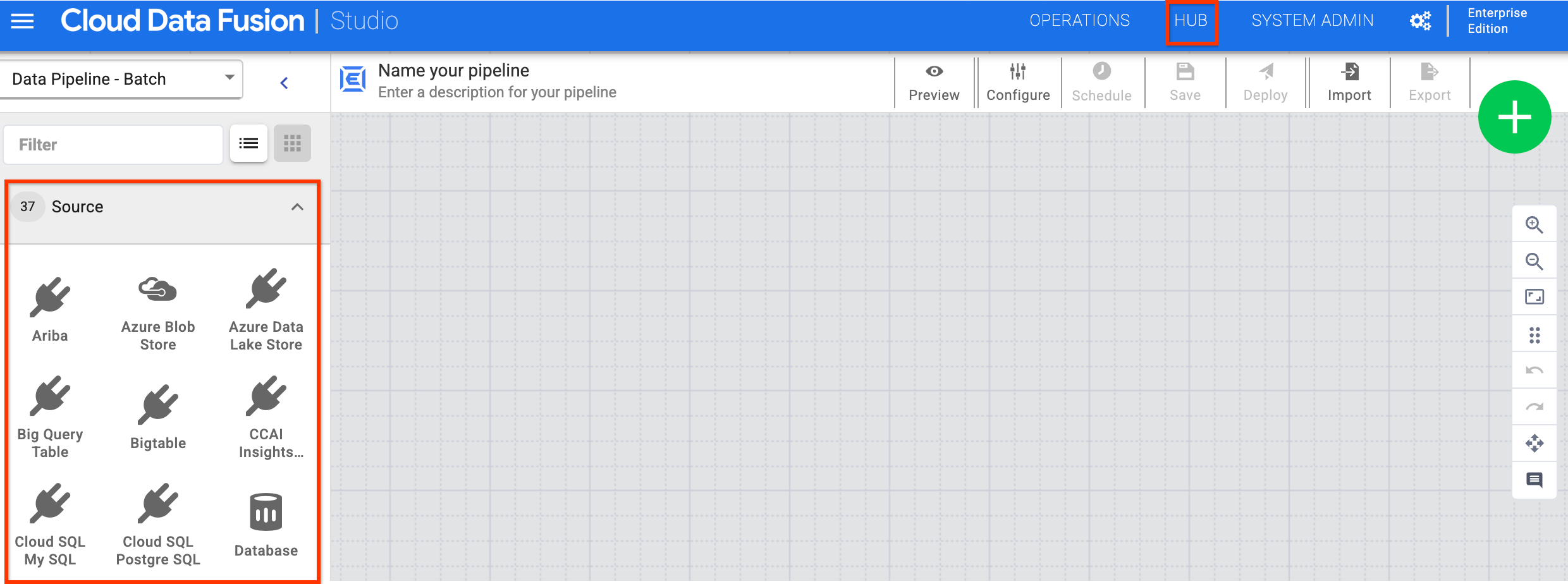

Para encontrar os plug-ins na interface da Web do Cloud Data Fusion, acesse a página Studio. Para mais plug-ins, clique em Hub.

Tipos de plug-in

Os plug-ins são categorizados nas seguintes categorias:

- Fontes

- Transformações

- Analytics

- Coletores

- Condições e ações

- Alertas e gerenciadores de erros

Fontes

Os plug-ins de origem se conectam a bancos de dados, arquivos ou streams em tempo real de onde o pipeline lê dados. Você configura fontes para o pipeline de dados usando a interface da Web, para que não precise se preocupar com a codificação de conexões de baixo nível.

Transformações

Os plug-ins de transformação mudam os dados depois que eles são ingeridos de uma fonte. Por exemplo, é possível clonar um registro, mudar o formato do arquivo para JSON ou usar o plug-in JavaScript para criar uma transformação personalizada.

Analytics

Os plug-ins de análise executam agregações, como a união de dados de diferentes fontes e a execução de operações de análise e machine learning.

Coletores

Os plug-ins de coletor gravam dados em recursos, como o Cloud Storage, o BigQuery, o Spanner, bancos de dados relacionais, sistemas de arquivos e mainframes. É possível consultar os dados gravados no destino usando a interface da Web do Cloud Data Fusion ou a API REST.

Condições e ações

Use plug-ins de condição e ação para programar ações que ocorrem durante um fluxo de trabalho e não manipulam dados diretamente. Exemplo:

- Use o plug-in do banco de dados para programar a execução de um comando do banco de dados no final do pipeline.

- Use o plug-in Mover arquivos para acionar uma ação que move arquivos no Cloud Storage.

Alertas e gerenciadores de erros

Quando as fases encontram valores nulos, erros lógicos ou outras fontes de erros, é possível usar um plug-in de gerenciador de erros para detectar erros. Use esses plug-ins para encontrar erros na saída após um plug-in de transformação ou análise. É possível gravar os erros em um banco de dados para análise.

A seguir

- Conheça os plug-ins.

- Crie um pipeline de dados com os plug-ins.