您可以將 Enterprise Document OCR 納入 Document AI,偵測及擷取各種文件中的文字和版面配置資訊。透過可設定的功能,您可以根據特定文件處理需求調整系統。

總覽

您可以使用 Enterprise Document OCR 執行資料輸入等工作 (以演算法或機器學習為基礎),並提升及驗證資料準確度。您也可以使用 Enterprise Document OCR 處理下列工作:

- 數位化文字:從文件中擷取文字和版面配置資料,用於搜尋、以規則為準的文件處理管道,或建立自訂模型。

- 使用大型語言模型應用程式:運用 LLM 的情境理解能力和 OCR 的文字與版面配置擷取功能,自動生成問題和答案。從資料中取得深入分析結果,並簡化工作流程。

- 封存:將紙本文件數位化為機器可讀取的文字,提升文件無障礙程度。

根據用途選擇最佳 OCR

| 解決方案 | 產品 | 說明 | 用途 |

|---|---|---|---|

| Document AI | Enterprise Document OCR | 專為文件用途開發的模型。進階功能包括圖片品質分數、語言提示和旋轉修正。 | 建議用於從文件中擷取文字。適用於 PDF、掃描成圖片的文件或 Microsoft DocX 檔案。 |

| Document AI | OCR 外掛程式 | 進階功能可滿足特定需求。僅適用於 Enterprise Document OCR 2.0 以上版本。 | 需要偵測及辨識數學公式、接收字型樣式資訊,或啟用核取方塊擷取功能。 |

| Cloud Vision API | 文字偵測 | 全球通用的 REST API,以 Google Cloud 標準 OCR 模型為基礎。預設配額為每分鐘 1,800 項要求。 | 需要低延遲和高容量的一般文字擷取用途。 |

| Cloud Vision | OCR Google Distributed Cloud (已淘汰) | Google Cloud Marketplace 應用程式,可使用 GKE Enterprise 當做容器部署至任何 GKE 叢集。 | 符合資料落地或法規遵循要求。 |

偵測和擷取

Enterprise Document OCR 可偵測 PDF 和圖片中的文字區塊、段落、行、字詞和符號,並修正文件傾斜問題,提高準確度。

支援的版面配置偵測和擷取屬性:

| 印刷文字 | 手寫 | 段落 | 封鎖 | Line | Word | 符號層級 | 頁碼 |

|---|---|---|---|---|---|---|---|

| 預設 | 預設 | 預設 | 預設 | 預設 | 預設 | 可自行設定 | 預設 |

可設定的 Enterprise Document OCR 功能包括:

從數位 PDF 擷取內嵌或原生文字:這項功能會擷取來源文件中的文字和符號,即使是旋轉文字、極端的字型大小或樣式,以及部分隱藏的文字,也能準確擷取。

旋轉校正:使用 Enterprise Document OCR 預先處理文件圖片,修正可能影響擷取品質或處理程序的旋轉問題。

影像品質分數:取得有助於文件遞送的品質指標。圖片品質分數提供頁面層級的品質指標,包括模糊程度、字體是否比平常小,以及眩光等八個層面。

指定頁面範圍:指定要進行 OCR 的輸入文件頁面範圍。這樣就能節省不必要網頁的支出和處理時間。

語言偵測:偵測擷取文字中使用的語言。

語言和手寫提示:根據資料集的已知特徵,為 OCR 模型提供語言或手寫提示,提高準確率。

如要瞭解如何啟用 OCR 設定,請參閱「啟用 OCR 設定」。

OCR 附加元件

Enterprise Document OCR 提供選用的分析功能,可視需要針對個別處理要求啟用。

下列外掛程式功能適用於穩定版 pretrained-ocr-v2.0-2023-06-02 和 pretrained-ocr-v2.1-2024-08-07,以及候選版本 pretrained-ocr-v2.1.1-2025-01-31。

- 數學 OCR:從 LaTeX 格式的文件中識別及擷取公式。

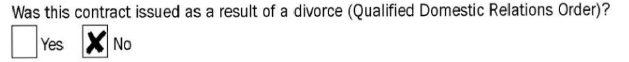

- 核取方塊擷取:在 Enterprise Document OCR 回應中偵測核取方塊,並擷取其狀態 (已勾選/未勾選)。

- 字型樣式偵測:識別字級字型屬性,包括字型、字型樣式、手寫字、粗細和顏色。

如要瞭解如何啟用所列外掛程式,請參閱「啟用 OCR 外掛程式」。

支援的檔案格式

Enterprise Document OCR 支援 PDF、GIF、TIFF、JPEG、PNG、BMP 和 WebP 檔案格式。詳情請參閱「支援的檔案」。

Enterprise Document OCR 也支援最多 15 頁的同步 DocX 檔案,以及最多 30 頁的非同步檔案。如要提出配額提高要求 (QIR),請按照「申請調整配額」一文中的步驟操作。 DocX 支援功能目前為不公開預先發布版。如要要求存取權,請與 Google 帳戶團隊聯絡。

進階版本管理

進階版本控管功能目前為預先發布版,升級基礎 AI/機器學習 OCR 模型可能會導致 OCR 行為發生變化。如需嚴格一致性,請使用凍結的模型版本,將行為固定在舊版 OCR 模型上,最多可達 18 個月。這可確保 OCR 函式結果與圖片相同。請參閱處理器版本資料表。

處理器版本

這項功能支援下列處理器版本。詳情請參閱「管理處理器版本」。

| 版本 ID | 發布版本 | 說明 |

|---|---|---|

pretrained-ocr-v1.2-2022-11-10 |

穩定 | 凍結的 1.0 版模型:模型檔案、設定和二進位檔會凍結在容器映像檔中,最多可保留 18 個月。 |

pretrained-ocr-v2.0-2023-06-02 |

穩定 | 專為文件用途設計的實際工作環境適用模型。包括所有 OCR 外掛程式的存取權。 |

pretrained-ocr-v2.1-2024-08-07 |

穩定 | 2.1 版的主要改良項目包括:提升印刷文字辨識能力、更精準地偵測核取方塊,以及更準確地判讀閱讀順序。 |

pretrained-ocr-v2.1.1-2025-01-31 |

候選版本 | v2.1.1 與 V2.1 類似,適用於所有區域,但 US、EU 和 asia-southeast1 除外。 |

使用 Enterprise Document OCR 處理文件

本快速入門導覽課程介紹 Enterprise Document OCR。本文說明如何啟用或停用可用的 OCR 設定,進而為工作流程最佳化文件 OCR 結果。

- Sign in to your Google Cloud account. If you're new to Google Cloud, create an account to evaluate how our products perform in real-world scenarios. New customers also get $300 in free credits to run, test, and deploy workloads.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the Document AI API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles. -

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the Document AI API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles. quality/defect_blurryquality/defect_noisyquality/defect_darkquality/defect_faintquality/defect_text_too_smallquality/defect_document_cutoffquality/defect_text_cutoffquality/defect_glare- 如果數位文件沒有任何瑕疵,這項功能可能會誤判。這項功能最適合用於掃描或拍攝的文件。

眩光瑕疵是局部問題。但可能不會影響文件的整體可讀性。

- 如要只處理第二頁和第五頁:

- 如要只處理前三頁:

- 如要只處理最後四頁:

偵測到圖片

轉換為 LaTeX

- Vision AI API 回應只會填入圖片要求的

vertices,以及 PDF 要求的normalized_vertices。Document AI 回應和轉換器會填入vertices和normalized_vertices。 - Vision AI API 回應會在字詞的最後一個符號中填入

detected_break。Document AI API 回應和轉換器會在字詞和字詞的最後一個符號中填入detected_break。 - Vision AI API 回應一律會填入符號欄位。根據預設,Document AI 回應不會填入符號欄位。如要確保 Document AI 回應和轉換器會填入符號欄位,請將

enable_symbol功能設為詳細。 - LOCATION:處理器的位置,例如:

us- 美國eu- 歐盟

- PROJECT_ID:您的 Google Cloud 專案 ID。

- PROCESSOR_ID:自訂處理器的 ID。

- PROCESSOR_VERSION:處理器版本 ID。詳情請參閱「選取處理器版本」。例如:

pretrained-TYPE-vX.X-YYYY-MM-DDstablerc

- skipHumanReview:用來停用人工審查的布林值 (僅限人機迴圈處理器支援)。

true- 略過人工審查false- 啟用人工審查 (預設)

- MIME_TYPE†:其中一個有效的 MIME 類型選項。

- IMAGE_CONTENT†:其中一個有效

內嵌文件內容,以位元組串流表示。如果是 JSON 表示法,則為二進位圖片資料的 base64 編碼 (ASCII 字串)。這個字串應類似下列字串:

/9j/4QAYRXhpZgAA...9tAVx/zDQDlGxn//2Q==

- FIELD_MASK:指定要納入

Document輸出內容的欄位。這是以半形逗號分隔的完整欄位名稱清單,格式為FieldMask。- 範例:

text,entities,pages.pageNumber

- 範例:

- OCR 設定

- ENABLE_NATIVE_PDF_PARSING:(布林值) 從 PDF 擷取內嵌文字 (如有)。

- ENABLE_IMAGE_QUALITY_SCORES:(布林值) 啟用智慧文件品質分數。

- ENABLE_SYMBOL:(布林值) 包含符號 (字母) OCR 資訊。

- DISABLE_CHARACTER_BOXES_DETECTION:(布林值) 關閉 OCR 引擎中的字元方塊偵測工具。

- LANGUAGE_HINTS:用於 OCR 的 BCP-47 語言代碼清單。

- ADVANCED_OCR_OPTIONS:進階 OCR 選項清單,可進一步微調 OCR 行為。目前有效值如下:

legacy_layout:啟發式版面配置偵測演算法,可做為目前以機器學習為基礎的版面配置偵測演算法替代方案。

- 進階 OCR 外掛程式

- ENABLE_SELECTION_MARK_DETECTION:(布林值) 啟用 OCR 引擎的選取標記偵測工具。

- COMPUTE_STYLE_INFO (布林值) 啟用字型識別模型,並傳回字型樣式資訊。

- ENABLE_MATH_OCR:(布林值) 啟用可擷取 LaTeX 數學公式的模型。

- INDIVIDUAL_PAGES:要處理的個別頁面清單。

建立 Enterprise Document OCR 處理器

首先,請建立 Enterprise Document OCR 處理器。詳情請參閱「建立及管理處理器」。

OCR 設定

如要啟用所有 OCR 設定,請在 ProcessDocumentRequest 或 BatchProcessDocumentsRequest 中,將 ProcessOptions.ocrConfig 內的對應欄位設為 。

詳情請參閱「傳送處理要求」。

圖片品質分析

智慧型文件品質分析功能會運用機器學習技術,根據文件內容的可讀性評估文件品質。

這項品質評估會以品質分數 [0, 1] 的形式回傳,其中 1 代表品質完美。

如果偵測到的品質分數低於 0.5,系統也會傳回負面品質原因清單 (依可能性排序)。

如果可能性大於 0.5,系統就會視為偵測到正向結果。

如果文件有瑕疵,API 會傳回下列八種文件瑕疵類型:

目前的文件品質分析功能有以下限制:

輸入

在處理要求中將 ProcessOptions.ocrConfig.enableImageQualityScores 設為 true,即可啟用這項功能。

這項額外功能會使程序呼叫進一步延遲,額外延遲的時間與 OCR 處理作業相當。

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"enableImageQualityScores": true

}

}

}

輸出

瑕疵偵測結果會顯示在 Document.pages[].imageQualityScores[] 中。

{

"pages": [

{

"imageQualityScores": {

"qualityScore": 0.7811847,

"detectedDefects": [

{

"type": "quality/defect_document_cutoff",

"confidence": 1.0

},

{

"type": "quality/defect_glare",

"confidence": 0.97849524

},

{

"type": "quality/defect_text_cutoff",

"confidence": 0.5

}

]

}

}

]

}

如需完整的輸出內容範例,請參閱「處理器輸出內容範例」。

語言提示

OCR 處理器支援您定義的語言提示,可提升 OCR 引擎效能。套用語言提示後,OCR 會針對所選語言進行最佳化,而非推斷語言。

輸入

如要啟用這項功能,請使用 BCP-47 語言代碼清單設定 ProcessOptions.ocrConfig.hints[].languageHints[]。

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"hints": {

"languageHints": ["en", "es"]

}

}

}

}

如需完整的輸出內容範例,請參閱「處理器輸出內容範例」。

符號偵測

在文件回應中,以符號 (或個別字母) 層級填入資料。

輸入

在處理要求中將 ProcessOptions.ocrConfig.enableSymbol 設為 true,即可啟用這項功能。

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"enableSymbol": true

}

}

}

輸出

如果啟用這項功能,系統會填入 Document.pages[].symbols[] 欄位。

如需完整的輸出內容範例,請參閱「處理器輸出內容範例」。

內建 PDF 剖析功能

從數位 PDF 檔案中擷取內嵌文字。啟用後,如果 PDF 含有數位文字,系統會自動使用內建的數位 PDF 模型。如果圖片中含有非數位文字,系統會自動使用光學 OCR 模型。使用者會收到合併後的文字結果。

輸入

在處理要求中將 ProcessOptions.ocrConfig.enableNativePdfParsing 設為 true,即可啟用這項功能。

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"enableNativePdfParsing": true

}

}

}

偵測角色是否在框內

根據預設,Enterprise Document OCR 會啟用偵測器,以提升方塊內字元的文字擷取品質。範例如下:

如果方塊內的字元發生 OCR 品質問題,可以停用這項功能。

輸入

在處理要求中將 ProcessOptions.ocrConfig.disableCharacterBoxesDetection 設為 true,即可停用這項功能。

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"disableCharacterBoxesDetection": true

}

}

}

舊版版面配置

如果您需要使用啟發式版面配置偵測演算法,可以啟用舊版版面配置,做為目前以機器學習為基礎的版面配置偵測演算法替代方案。我們不建議採用此設定。顧客可以根據文件工作流程,選擇最合適的版面配置演算法。

輸入

在處理要求中將 ProcessOptions.ocrConfig.advancedOcrOptions 設為 ["legacy_layout"],即可啟用這項功能。

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"advancedOcrOptions": ["legacy_layout"]

}

}

}

指定頁面範圍

根據預設,OCR 會從文件中的所有頁面擷取文字和版面配置資訊。您可以選取特定頁碼或頁碼範圍,只擷取這些頁面的文字。

您可以在 ProcessOptions 中透過三種方式設定這項功能:

{

"individualPageSelector": {"pages": [2, 5]}

}

{

"fromStart": 3

}

{

"fromEnd": 4

}

在回應中,每個 Document.pages[].pageNumber 都對應要求中指定的相同頁面。

OCR 外掛程式用途

您可以視需要,在個別處理要求中啟用這些 Enterprise Document OCR 選用分析功能。

數學 OCR

數學 OCR 可偵測、辨識及擷取公式,例如以 LaTeX 表示的數學方程式,以及定界框座標。

以下是 LaTeX 表示法的範例:

輸入

在處理要求中將 ProcessOptions.ocrConfig.premiumFeatures.enableMathOcr 設為 true,即可啟用這項功能。

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"premiumFeatures": {

"enableMathOcr": true

}

}

}

}

輸出

數學 OCR 輸出內容會顯示在 Document.pages[].visualElements[] 中,並附上 "type": "math_formula"。

"visualElements": [

{

"layout": {

"textAnchor": {

"textSegments": [

{

"endIndex": "46"

}

]

},

"confidence": 1,

"boundingPoly": {

"normalizedVertices": [

{

"x": 0.14662756,

"y": 0.27891156

},

{

"x": 0.9032258,

"y": 0.27891156

},

{

"x": 0.9032258,

"y": 0.8027211

},

{

"x": 0.14662756,

"y": 0.8027211

}

]

},

"orientation": "PAGE_UP"

},

"type": "math_formula"

}

]

選取標記擷取

啟用這項設定後,模型會嘗試擷取文件中的所有核取方塊和選項按鈕,以及定界框座標。

輸入

在處理要求中將 ProcessOptions.ocrConfig.premiumFeatures.enableSelectionMarkDetection 設為 true,即可啟用這項功能。

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"premiumFeatures": {

"enableSelectionMarkDetection": true

}

}

}

}

輸出

核取方塊輸出內容會顯示在 Document.pages[].visualElements[] 中,並包含 "type": "unfilled_checkbox" 或 "type": "filled_checkbox"。

"visualElements": [

{

"layout": {

"confidence": 0.89363575,

"boundingPoly": {

"vertices": [

{

"x": 11,

"y": 24

},

{

"x": 37,

"y": 24

},

{

"x": 37,

"y": 56

},

{

"x": 11,

"y": 56

}

],

"normalizedVertices": [

{

"x": 0.017488075,

"y": 0.38709676

},

{

"x": 0.05882353,

"y": 0.38709676

},

{

"x": 0.05882353,

"y": 0.9032258

},

{

"x": 0.017488075,

"y": 0.9032258

}

]

}

},

"type": "unfilled_checkbox"

},

{

"layout": {

"confidence": 0.9148201,

"boundingPoly": ...

},

"type": "filled_checkbox"

}

],

偵測字型樣式

啟用字型樣式偵測功能後,Enterprise Document OCR 會擷取字型屬性,以便進行後續處理。

在權杖 (字詞) 層級,系統會偵測到下列屬性:

輸入

在處理要求中將 ProcessOptions.ocrConfig.premiumFeatures.computeStyleInfo 設為 true,即可啟用這項功能。

{

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"processOptions": {

"ocrConfig": {

"premiumFeatures": {

"computeStyleInfo": true

}

}

}

}

輸出

字型樣式輸出內容會顯示在 Document.pages[].tokens[].styleInfo 中,類型為 StyleInfo。

"tokens": [

{

"styleInfo": {

"fontSize": 3,

"pixelFontSize": 13,

"fontType": "SANS_SERIF",

"bold": true,

"fontWeight": 564,

"textColor": {

"red": 0.16862746,

"green": 0.16862746,

"blue": 0.16862746

},

"backgroundColor": {

"red": 0.98039216,

"green": 0.9882353,

"blue": 0.99215686

}

}

},

...

]

將文件物件轉換為 Vision AI API 格式

Document AI 工具箱內含可將 Document AI API Document 格式轉換為 Vision AI AnnotateFileResponse 格式的工具,方便使用者比較文件 OCR 處理器和 Vision AI API 的回應。以下是程式碼範例。

Vision AI API 回應與 Document AI API 回應和轉換器之間的已知差異:

程式碼範例

下列程式碼範例示範如何傳送處理要求,啟用 OCR 設定和外掛程式,然後在終端機讀取及列印欄位:

REST

使用任何要求資料之前,請先替換以下項目:

† 您也可以在 inlineDocument 物件中使用 Base64 編碼的內容指定這項內容。

HTTP 方法和網址:

POST https://LOCATION-documentai.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/processors/PROCESSOR_ID/processorVersions/PROCESSOR_VERSION:process

JSON 要求主體:

{

"skipHumanReview": skipHumanReview,

"rawDocument": {

"mimeType": "MIME_TYPE",

"content": "IMAGE_CONTENT"

},

"fieldMask": "FIELD_MASK",

"processOptions": {

"ocrConfig": {

"enableNativePdfParsing": ENABLE_NATIVE_PDF_PARSING,

"enableImageQualityScores": ENABLE_IMAGE_QUALITY_SCORES,

"enableSymbol": ENABLE_SYMBOL,

"disableCharacterBoxesDetection": DISABLE_CHARACTER_BOXES_DETECTION,

"hints": {

"languageHints": [

"LANGUAGE_HINTS"

]

},

"advancedOcrOptions": ["ADVANCED_OCR_OPTIONS"],

"premiumFeatures": {

"enableSelectionMarkDetection": ENABLE_SELECTION_MARK_DETECTION,

"computeStyleInfo": COMPUTE_STYLE_INFO,

"enableMathOcr": ENABLE_MATH_OCR,

}

},

"individualPageSelector" {

"pages": [INDIVIDUAL_PAGES]

}

}

}

如要傳送要求,請選擇以下其中一個選項:

curl

將要求主體儲存在名為 request.json 的檔案中,然後執行下列指令:

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://LOCATION-documentai.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/processors/PROCESSOR_ID/processorVersions/PROCESSOR_VERSION:process"

PowerShell

將要求主體儲存在名為 request.json 的檔案中,然後執行下列指令:

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://LOCATION-documentai.googleapis.com/v1/projects/PROJECT_ID/locations/LOCATION/processors/PROCESSOR_ID/processorVersions/PROCESSOR_VERSION:process" | Select-Object -Expand Content

如果要求成功,伺服器會傳回 200 OK HTTP 狀態碼與 JSON 格式的回應。回應主體包含 Document 的例項。

Python

詳情請參閱 Document AI Python API 參考說明文件。

如要向 Document AI 進行驗證,請設定應用程式預設憑證。 詳情請參閱「為本機開發環境設定驗證」。