Monitorar VMs da Cloud TPU

Neste guia, explicamos como usar o Google Cloud Monitoring para monitorar as VMs do Cloud TPU. Google Cloud O Monitoring coleta automaticamente métricas e registros do Cloud TPU e do Compute Engine host. Esses dados podem ser usados para monitorar a integridade da Cloud TPU e do Compute Engine.

Com as métricas, é possível rastrear uma quantidade numérica ao longo do tempo, por exemplo, utilização da CPU, uso da rede ou duração ociosa do TensorCore. Os registros capturam eventos em um momento específico. As entradas de registro são escritas pelo seu próprio código, Google Cloud serviços, aplicativos de terceiros e a Google Cloud infraestrutura. Também é possível gerar métricas com base nos dados de uma entrada de registro criando uma métrica com base em registros. Também é possível definir políticas de alertas com base em valores de métricas ou entradas de registro.

Este guia aborda o Google Cloud Monitoring e mostra como:

- Ver métricas do Cloud TPU

- Configurar políticas de alerta de métricas do Cloud TPU

- Consultar registros da Cloud TPU

- Criar métricas com base em registros para configurar alertas e visualizar painéis

Para monitorar TPUs, você também pode usar o Planejador de capacidade (prévia). Com o Planejador de capacidade, é possível conferir dados de uso e previsão de TPU do seu projeto, pasta ou organização. Esses dados são atualizados a cada 24 horas e podem ser usados para analisar tendências de uso e planejar necessidades futuras de capacidade. Para mais informações, consulte Visão geral do Planejador de capacidade.

Este documento considera alguns conhecimentos básicos sobre o Google Cloud Monitoring. Você precisa ter uma VM do Compute Engine e recursos da Cloud TPU criados antes de começar a gerar e trabalhar com o Google Cloud Monitoring. Consulte o Guia de início rápido do Cloud TPU para mais detalhes.

Métricas

AsGoogle Cloud métricas são geradas automaticamente pelas VMs do Compute Engine e pelo tempo de execução da Cloud TPU. As seguintes métricas são geradas pelas VMs do Cloud TPU:

memory/usagenetwork/received_bytes_countnetwork/sent_bytes_countcpu/utilizationtpu/tensorcore/idle_durationaccelerator/tensorcore_utilizationaccelerator/memory_bandwidth_utilizationaccelerator/duty_cycleaccelerator/memory_totalaccelerator/memory_used

Pode levar até 180 segundos entre o momento em que um valor de métrica é gerado e quando ele é mostrado no Explorador de métricas.

Para uma lista completa de métricas geradas pelo Cloud TPU, consulte Google Cloud Métricas do Cloud TPU.

Uso da memória

A métrica memory/usage é gerada para o recurso TPU Worker e rastreia a memória usada pela VM da TPU em bytes. Essa métrica é amostrada a cada 60 segundos.

Contagem de bytes recebidos da rede

A métrica network/received_bytes_count é gerada para o recurso TPU Worker e rastreia o número de bytes cumulativos de dados que a VM da TPU recebeu pela rede em um determinado momento.

Contagem de bytes enviados da rede

A métrica network/sent_bytes_count é gerada para o recurso TPU Worker e rastreia o número de bytes cumulativos que a VM da TPU enviou pela rede em um determinado momento.

Uso da CPU

A métrica cpu/utilization é gerada para o recurso TPU Worker e rastreia a utilização atual da CPU no worker da TPU, representada como uma porcentagem, com amostragem uma vez por minuto. Os valores geralmente estão entre 0,0 e 100,0, mas podem exceder 100,0.

Duração da inatividade do TensorCore

A métrica tpu/tensorcore/idle_duration é gerada para o recurso TPU Worker e rastreia o número de segundos em que o TensorCore de cada chip da TPU ficou ocioso. Essa métrica está disponível para cada chip em todas as TPUs em uso. Se um TensorCore estiver em uso, o valor da duração de inatividade será redefinido como zero. Quando o TensorCore não estiver mais em uso, o valor da duração ociosa começará a aumentar.

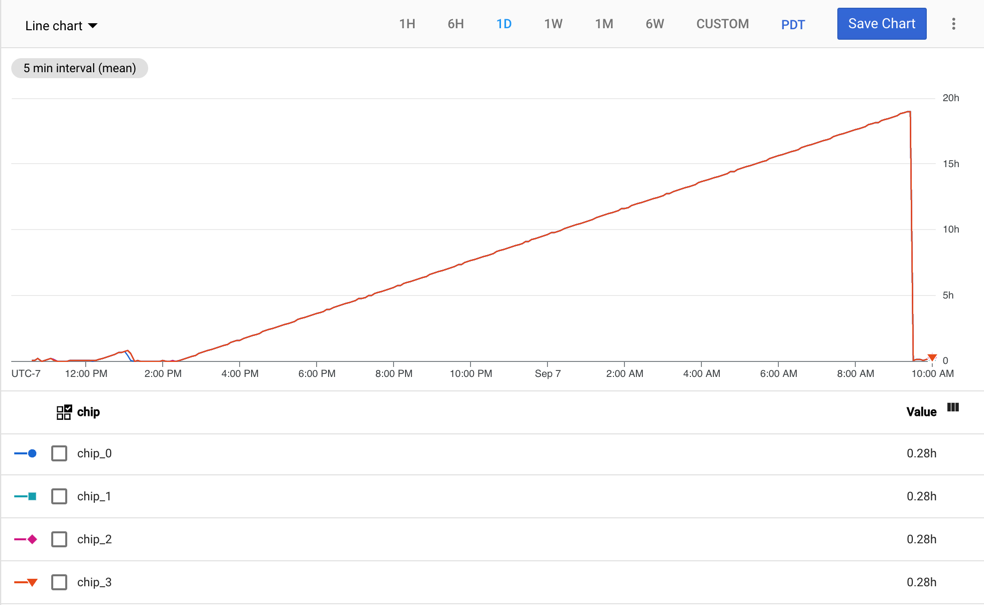

O gráfico a seguir mostra a métrica tpu/tensorcore/idle_duration para uma VM de TPU v2-8 com um worker. Cada worker tem quatro chips. Neste exemplo, todos os quatro chips têm os mesmos valores para tpu/tensorcore/idle_duration. Portanto, os gráficos são sobrepostos.

Uso do TensorCore

A métrica accelerator/tensorcore_utilization é gerada para o recurso GCE TPU

Worker e rastreia a porcentagem atual do TensorCore que está sendo utilizada. Essa métrica é calculada dividindo o número de operações do TensorCore realizadas em um período de amostragem pelo número máximo de operações que podem ser realizadas no mesmo período. Um valor maior significa melhor utilização. A métrica de utilização do TensorCore é compatível com a v4 e gerações mais recentes de TPU.

Utilização de largura de banda de memória

A métrica accelerator/memory_bandwidth_utilization é gerada para o recurso GCE TPU Worker e rastreia a porcentagem atual da largura de banda da memória do acelerador que está sendo usada. Essa métrica é calculada dividindo a largura de banda da memória usada durante um período de amostragem pela largura de banda máxima aceita no mesmo período. Um valor maior significa melhor utilização. A métrica de utilização da largura de banda de memória é compatível com a v4 e gerações mais recentes de TPU.

Ciclo de trabalho do acelerador

A métrica accelerator/duty_cycle é gerada para o recurso GCE TPU Worker e rastreia a porcentagem de tempo durante o período de amostra em que o TensorCore do acelerador estava processando ativamente. Os valores estão no intervalo de 0 a 100. Um valor maior significa melhor uso do TensorCore. Essa métrica é informada quando uma carga de trabalho de machine learning está sendo executada na VM da TPU. A métrica "Ciclo de trabalho do acelerador" é compatível com JAX 0.4.14 e versões mais recentes, PyTorch 2.1 e versões mais recentes e

TensorFlow 2.14.0 e versões mais recentes.

Memória total do acelerador

A métrica accelerator/memory_total é gerada para o recurso GCE TPU Worker e rastreia a memória total do acelerador alocada em bytes.

Essa métrica é informada quando uma carga de trabalho de machine learning está sendo executada na VM da TPU. A métrica "Total de memória do acelerador" é compatível com JAX

0.4.14 e versões mais recentes,

PyTorch

2.1 e versões mais recentes e

TensorFlow

2.14.0 e

versões mais recentes.

Memória do acelerador usada

A métrica accelerator/memory_used é gerada para o recurso GCE TPU Worker e rastreia a memória total do acelerador usada em bytes. Essa métrica é informada quando uma carga de trabalho de machine learning está sendo executada na VM da TPU. A métrica "Memória usada do acelerador" é compatível com JAX 0.4.14 e versões mais recentes, PyTorch 2.1 e versões mais recentes e

TensorFlow 2.14.0 e versões mais recentes.

Como ver métricas

É possível conferir as métricas usando o Metrics Explorer no console Google Cloud .

No Metrics Explorer, clique em Selecionar uma métrica e pesquise TPU Worker ou GCE TPU Worker, dependendo da métrica que você quer.

Selecione um recurso para mostrar todas as métricas disponíveis dele.

Se a opção Ativo estiver habilitada, somente as métricas com dados de série temporal nas últimas 25 horas serão listadas. Desative a opção Ativo para listar todas as métricas.

Também é possível acessar métricas usando chamadas HTTP curl.

Use o botão Testar na documentação de projects.timeSeries.query para recuperar o valor de uma métrica no período especificado.

- Preencha o nome no seguinte formato:

projects/{project-name}. Adicione uma consulta à seção Corpo da solicitação. Confira a seguir um exemplo de consulta para recuperar a métrica de duração ociosa da zona especificada nos últimos cinco minutos.

fetch tpu_worker | filter zone = 'us-central2-b' | metric tpu.googleapis.com/tpu/tensorcore/idle_duration | within 5mClique em Executar para fazer a chamada e conferir os resultados da mensagem HTTP POST.

O documento Referência da linguagem de consulta do Monitoring tem mais informações sobre como personalizar essa consulta.

Como criar alertas

É possível criar políticas de alertas que informam ao Cloud Monitoring para enviar um alerta quando uma condição for atendida.

As etapas nesta seção mostram um exemplo de como adicionar uma política de alerta para a métrica Duração ociosa do TensorCore. Sempre que essa métrica exceder 24 horas, o Cloud Monitoring enviará um e-mail para o endereço registrado.

- Acesse o console do Monitoring.

- No painel de navegação, clique em Alertas.

- Clique em Editar canais de notificação.

- Em E-mail, clique em Adicionar novo. Digite um endereço de e-mail, um nome de exibição e clique em Salvar.

- Na página de alertas, clique em Criar política.

- Clique em Selecionar uma métrica e escolha Duração ociosa do Tensorcore. Depois, clique em Aplicar.

- Clique em Próxima e em Limite.

- Em Gatilho de alerta, selecione Qualquer série temporal viola.

- Em Posição do limite, selecione Acima do limite.

- Em Valor do limite, digite

86400000. - Clique em Próxima.

- Em Canais de notificação, selecione seu canal de notificação por e-mail e clique em OK.

- Digite um nome para a política de alertas.

- Clique em Próxima e em Criar política.

Quando a duração ociosa do TensorCore excede 24 horas, um e-mail é enviado para o endereço especificado.

Logging

As entradas de registro são gravadas por serviços Google Cloud , serviços de terceiros, frameworks de ML ou seu código. É possível conferir os registros usando o Explorador de registros ou a API Logging. Para mais informações sobre a geração de registros do Google Cloud , consulte Google Cloud Logging.

Os registros do worker da TPU contêm informações sobre um worker específico da Cloud TPU em uma zona específica, por exemplo, a quantidade de memória disponível no worker da Cloud TPU (system_available_memory_GiB).

Os registros de recursos auditados contêm informações sobre quando uma API específica do Cloud TPU foi chamada e quem fez a chamada. Por exemplo, você pode encontrar informações sobre chamadas para as APIs CreateNode, UpdateNode e DeleteNode.

Os frameworks de ML podem gerar registros para saída padrão e erro padrão. Esses registros são controlados por variáveis de ambiente e lidos pelo script de treinamento.

Seu código pode gravar registros no Google Cloud Logging. Para mais informações, consulte Gravar registros padrão e Gravar registros estruturados.

Geração de registros da porta serial

A Cloud TPU depende da geração de registros da porta serial para solução de problemas, monitoramento e depuração. O padrão é ativar a geração de registros da porta serial. Se a geração de registros da porta serial não estiver ativada, o processo de criação da VM de TPU vai falhar e gerar a seguinte mensagem de erro.

"Cloud TPU received a bad request. Constraint

`constraints/compute.disableSerialPortLogging` violated. Create TPUs with

serial port logging enabled or remove the Organization Policy Constraint."

Essa mensagem indica que a restrição constraints/compute.disableSerialPortLogging foi violada.

Para evitar esse erro, verifique se o registro da porta serial está permitido nos seus projetos de TPU. A prática recomendada é substituir a política da organização no nível do projeto.

Para mais informações sobre como ativar a geração de registros da porta serial, consulte Como ativar e desativar a geração de registros de saída da porta serial.

Consultar registros do Google Cloud

Quando você visualiza registros no console Google Cloud , a página executa uma consulta padrão.

Para conferir a consulta, selecione a chave seletora Show query. Você pode

modificar a consulta padrão ou criar uma nova. Para mais informações, consulte

Criar consultas no Explorador de registros.

Registros de recursos auditados

Para ver os registros de recursos auditados:

- Acesse o Google Cloud Explorador de registros.

- Clique no menu suspenso Todos os recursos.

- Clique em Recurso auditado e em Cloud TPU.

- Escolha a API Cloud TPU de seu interesse.

- Clique em Aplicar. Os registros são exibidos nos resultados da consulta.

Clique em qualquer entrada de registro para abrir. Cada entrada de registro tem vários campos, incluindo:

- logName: o nome do registro

- protoPayload -> @type: o tipo do registro

- protoPayload -> resourceName: o nome da sua Cloud TPU

- protoPayload -> methodName: o nome do método chamado (somente registros de auditoria)

- protoPayload -> request -> @type: o tipo de solicitação

- protoPayload -> request -> node: detalhes sobre o nó do Cloud TPU

- protoPayload -> request -> node_id: o nome da TPU

- severity: a gravidade do registro

Registros do worker da TPU

Para conferir os registros do worker da TPU:

- Acesse o Google Cloud Explorador de registros.

- Clique no menu suspenso Todos os recursos.

- Clique em Trabalhador da TPU.

- Selecione uma zona.

- Selecione a Cloud TPU de seu interesse.

- Clique em Aplicar. Os registros são exibidos nos resultados da consulta.

Clique em qualquer entrada de registro para abrir. Cada entrada de registro tem um campo chamado

jsonPayload. Expanda jsonPayload para ver vários campos, incluindo:

- accelerator_type: o tipo de acelerador

- consumer_project: o projeto em que a Cloud TPU está localizada

- evententry_timestamp: o horário em que o registro foi gerado.

- system_available_memory_GiB: a memória disponível no worker do Cloud TPU (0 ~ 350 GiB)

Como criar métricas com base em registros

Esta seção descreve como criar métricas com base em registros usadas para configurar painéis e alertas de monitoramento. Para informações sobre como criar métricas com base em registros de forma programática, consulte Como criar métricas com base em registros de forma programática usando a API REST do Cloud Logging.

O exemplo a seguir usa o subcampo system_available_memory_GiB para demonstrar como criar uma métrica com base em registros para monitorar a memória disponível do worker do Cloud TPU.

- Acesse o Google Cloud Explorador de registros.

Na caixa de consulta, insira a consulta a seguir para extrair todas as entradas de registro que tiverem system_available_memory_GiB definido para o worker principal do Cloud TPU:

resource.type=tpu_worker resource.labels.project_id=your-project resource.labels.zone=your-tpu-zone resource.labels.node_id=your-tpu-name resource.labels.worker_id=0 logName=projects/your-project/logs/tpu.googleapis.com%2Fruntime_monitor jsonPayload.system_available_memory_GiB:*

Clique em Criar métrica para abrir o Editor de métricas.

Em Tipo de métrica, escolha Distribuição.

Digite um nome, uma descrição opcional e uma unidade de medida para sua métrica. Neste exemplo, digite "matrix_unit_utilization_percent" e "MXU utilization" nos campos Nome e Descrição, respectivamente. O filtro é pré-preenchido com o script que você inseriu na Análise de registros.

Clique em Criar métrica.

Clique em Ver no Metrics Explorer para conferir sua nova métrica. Pode levar alguns minutos para que suas métricas sejam exibidas.

Como criar métricas com base em registros usando a API REST do Cloud Logging

Também é possível criar métricas com base em registros usando a API Cloud Logging. Para mais informações, consulte Como criar uma métrica de distribuição.

Como criar painéis e alertas usando métricas com base em registros

Os painéis são úteis para visualizar métricas (previsão de cerca de 2 minutos de atraso). Os alertas são úteis para enviar notificações quando ocorrem erros. Para mais informações, consulte estes tópicos:

- Painéis de monitoramento e geração de registros

- Gerenciar painéis personalizados

- Criar políticas de alertas com base em métricas

Como criar painéis

Para criar um painel no Cloud Monitoring para a métrica Duração ociosa do Tensor Core:

- Acesse o console do Monitoring.

- No painel de navegação, clique em Painéis.

- Clique em Criar painel e em Adicionar widget.

- Escolha o tipo de gráfico que você quer adicionar. Neste exemplo, escolha Linha.

- Digite um título para o widget.

- Clique no menu suspenso Selecionar uma métrica e digite "Duração ociosa do Tensor Core" no campo de filtro.

- Na lista de métricas, selecione TPU Worker -> Tpu -> Tensorcore idle duration.

- Para filtrar o conteúdo do painel, clique no menu suspenso Filtrar.

- Em Rótulos de recursos, selecione project_id.

- Escolha um comparador e digite um valor no campo Valor.

- Clique em Aplicar.