Le spiegazioni dell'IA forniscono funzionalità di visualizzazione integrate per i dati delle immagini. Quando richiedi una spiegazione su un modello di classificazione delle immagini con una visualizzazione configurata, visualizzerai la classe prevista insieme a un overlay immagine che mostra i pixel o le regioni che hanno contribuito alla previsione.

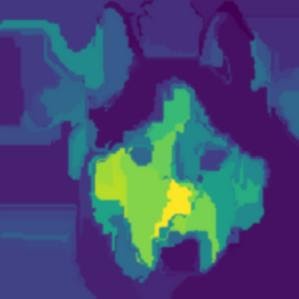

Le immagini di seguito mostrano le visualizzazioni su un'immagine di un husky. La visualizzazione a sinistra utilizza il metodo dei gradienti integrati ed evidenzia le aree di attribuzione positiva. La visualizzazione corretta utilizza un metodo XRAI con un gradiente di colore che indica le aree di influenza minore (blu) e maggiore (giallo) per fare una previsione positiva.

Il tipo di dati con cui lavori può influire sulla scelta di utilizzare un approccio con gradienti integrati o XRAI per visualizzare le spiegazioni.

- XRAI tende a funzionare meglio con le immagini naturali e fornisce un miglior riepilogo di informazioni di alto livello, ad esempio mostrando che l'attribuzione positiva è correlata alla forma del muso di un cane.

- I gradienti integrati (IG) tendono a fornire dettagli a livello di pixel e sono utili per scoprire attribuzioni più granulari.

Scopri di più sui metodi di attribuzione nella pagina Panoramica delle spiegazioni dell'IA.

Per iniziare

Le visualizzazioni sono configurate per modello nell'ambito del file di metadati della spiegazione.

Per aggiungere una nuova visualizzazione per il modello, includi un oggetto visualization

all'interno dell'oggetto inputs che vuoi visualizzare. Nell'oggetto visualization

puoi includere opzioni come il tipo di overlay utilizzato, le attribuzioni messe in evidenza, il colore e altro ancora. Tutte le impostazioni sono facoltative.

Per creare un'altra visualizzazione con lo stesso modello, aggiorna le impostazioni nel

explanation_metadata.json file e

riesegui il deployment del modello.

Opzioni di visualizzazione

Le impostazioni predefinite e consigliate dipendono dal metodo di attribuzione (gradienti integrati o XRAI). Di seguito è riportato un elenco di opzioni di configurazione e come utilizzarle. Per un elenco completo dei valori delle opzioni, consulta il riferimento all'API.

type: il tipo di visualizzazione utilizzato. Per i gradienti integrati,Outlinesè impostato per impostazione predefinita e mostra le regioni di attribuzione, mentrePixelsmostra l'attribuzione per pixel. Per XRAI,Pixelsè l'impostazione predefinita e mostra le aree di attribuzione.Outlinesnon è consigliato per XRAI.polarity: la direzione delle attribuzioni evidenziate.positiveè impostato per impostazione predefinita e mette in evidenza le aree con le attribuzioni positive più elevate. Ciò significa evidenziare i pixel che hanno avuto maggiore influenza sulla previsione positiva del modello. L'impostazione della polarità sunegativeevidenzia le aree che inducono il modello a non predire la classe positiva. L'utilizzo di una polarità negativa può essere utile per eseguire il debug del modello identificando le regioni con falsi negativi. Puoi anche impostare la polarizzazione subothper visualizzare le attribuzioni positive e negative.clip_above_percentile: esclude le attribuzioni al di sopra del percentile specificato dalle aree evidenziate. L'utilizzo combinato dei parametri del clip può essere utile per escludere il rumore e semplificare la visualizzazione delle aree di attribuzione significativa.clip_below_percentile: esclude le attribuzioni al di sotto del percentile specificato dalle aree evidenziate.color_map: la combinazione di colori utilizzata per le aree evidenziate. Il valore predefinito èpink_greenper i gradienti integrati, e mostra le attribuzioni positive in verde e quelle negative in rosa. Per le visualizzazioni XRAI, la mappa di colori è un gradiente. L'impostazione predefinita di XRAI èviridis, che evidenzia le regioni più significative in giallo e le meno significative in blu.overlay_type: come appare l'immagine originale nella visualizzazione. Se modifichi l'overlay, puoi migliorare la nitidezza visiva se l'immagine originale rende difficile la visualizzazione.

Configurazioni di esempio

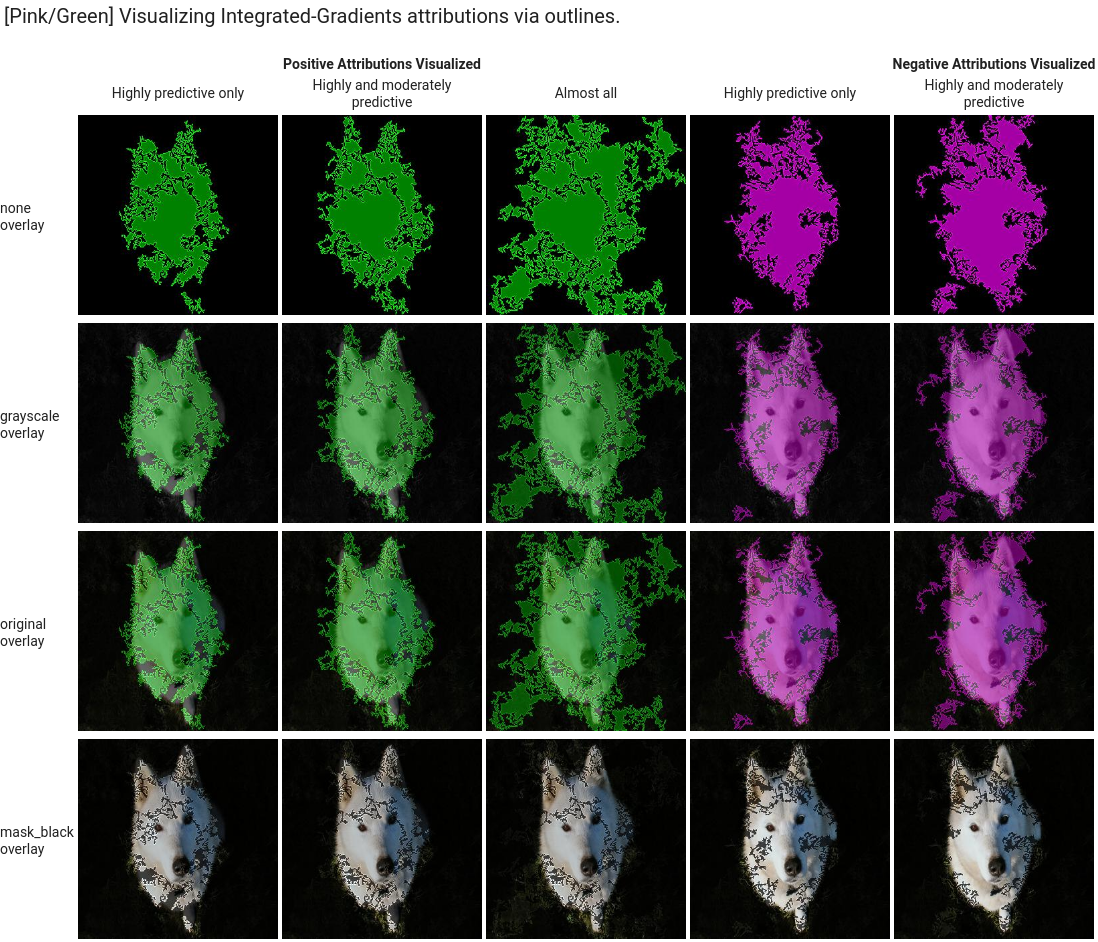

Per iniziare, di seguito sono riportati oggetti visualization di esempio che puoi utilizzare come punto di partenza e immagini che mostrano una serie di impostazioni applicate.

Gradienti integrati

Per i gradienti integrati, potrebbe essere necessario modificare i valori di clip se le aree di attribuzione sono troppo rumorose.

visualization: {

"type": "Outlines", # Can also use "Pixels"

"polarity": "positive",

"clip_below_percentile": 70,

"clip_above_percentile": 99.9,

"color_map": "pink_green",

"overlay_type": "grayscale"

}

Di seguito sono riportate due visualizzazioni che utilizzano entrambi i tipi Outlines e Pixels. Le colonne etichettate come "Solo altamente predittivo", "Moderatamente predittivo"

e "Quasi tutti" sono esempi di clip a diversi livelli che possono aiutarti

a focalizzare la visualizzazione.

![]()

XRAI

Per le visualizzazioni XRAI, ti consigliamo di iniziare senza valori di clip per XRAI perché l'overlay utilizza un gradiente per mostrare le aree di attribuzione alta e bassa.

visualization: {

"type": "Pixels", # Only valid option for XRAI

"polarity": "positive",

"clip_below_percentile": 0,

"clip_above_percentile": 100,

"color_map": "viridis",

"overlay_type": "grayscale"

}

L'immagine seguente è una visualizzazione XRAI che utilizza la mappa di colori viridis predefinita e una serie di tipi di overlay. Le aree in giallo indicano le regioni più significative che hanno contribuito positivamente alla previsione.

Passaggi successivi

Puoi anche utilizzare lo strumento What-If per visualizzare le spiegazioni. Per saperne di più, consulta i notebook di esempio.