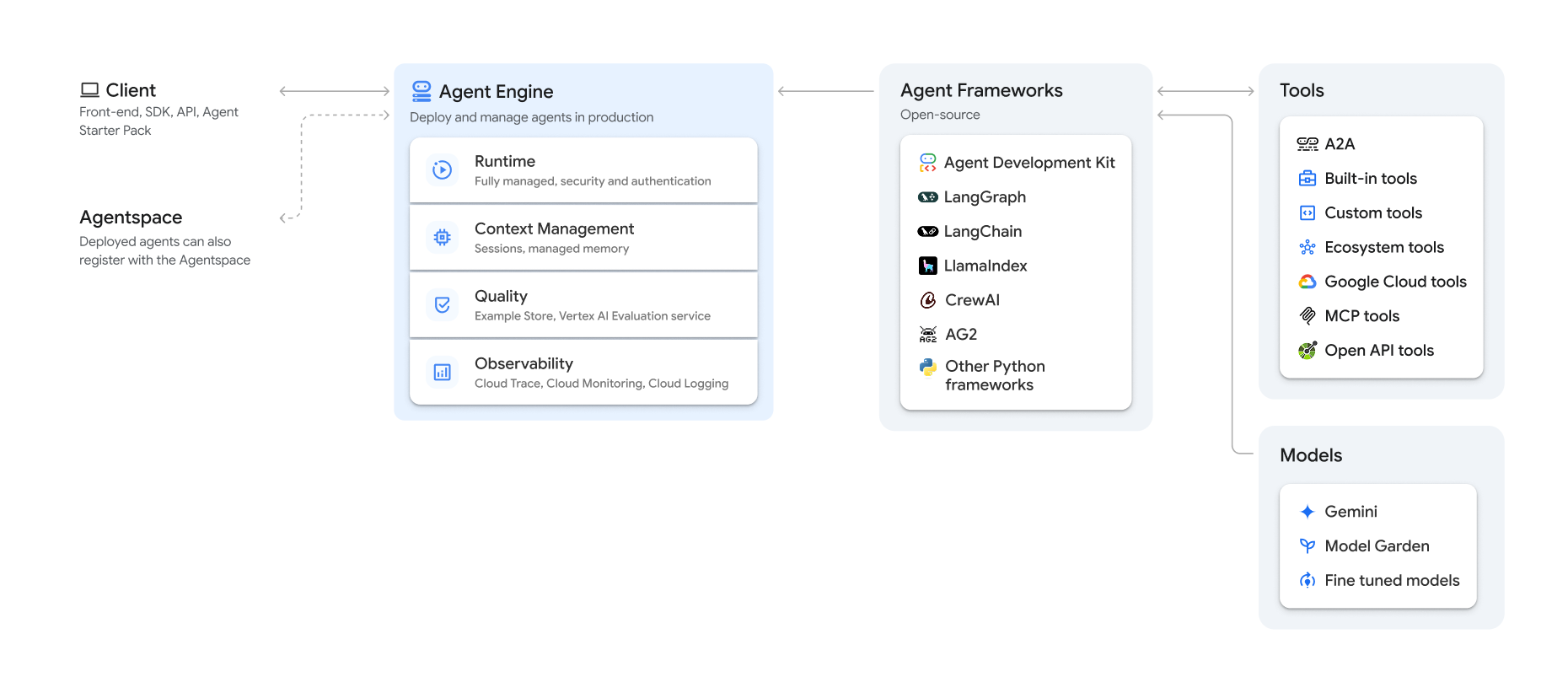

Vertex AI Agent Engine 是 Vertex AI Platform 的一部分,是一组可让开发者在生产环境中部署、管理和扩缩 AI 智能体的服务。Agent Engine 负责处理基础设施,使智能体在生产环境中能够自动伸缩,因此您可以专注于创建应用。Vertex AI Agent Engine 提供以下服务,您可以单独使用这些服务,也可以组合使用:

运行时:

- 利用托管式运行时和端到端管理功能部署和扩缩智能体。

- 使用系统依赖项的构建时安装脚本自定义智能体的容器映像。

- 使用安全功能,包括 VPC-SC 合规性以及身份验证和 IAM 的配置。

- 访问模型和工具,例如函数调用。

- 部署使用不同 Python 框架和 Agent2Agent 开放协议构建的智能体。

- 通过 Google Cloud Trace(支持 OpenTelemetry)、Cloud Monitoring 和 Cloud Logging 了解智能体行为。

质量和评估(预览版):使用集成的 Gen AI Evaluation Service 评估智能体质量,并通过 Gemini 模型训练运行优化智能体。

示例存储区(预览版):存储和动态检索少样本示例,以提升智能体性能。

会话(预览版):借助 Agent Engine 会话,您可以存储用户与智能体之间的个别互动,为对话上下文提供明确的来源。

记忆库(预览版):借助 Agent Engine 记忆库,您可以存储和检索会话信息,打造个性化智能体互动体验。

代码执行(预览版):借助 Agent Engine 代码执行,您的智能体可以在安全、隔离且受管理的沙盒环境中运行代码。

Vertex AI Agent Engine 是 Vertex AI Agent Builder 的一部分,后者是一套用于发现、构建和部署 AI 智能体的功能。

在 Vertex AI Agent Engine 上创建和部署

注意:如需使用 Vertex AI Agent Engine 获得简化的基于 IDE 的开发和部署体验,请考虑使用 agent-starter-pack。它提供即用型模板、用于实验的内置界面,并简化了部署、运营、评估、自定义和可观测性。

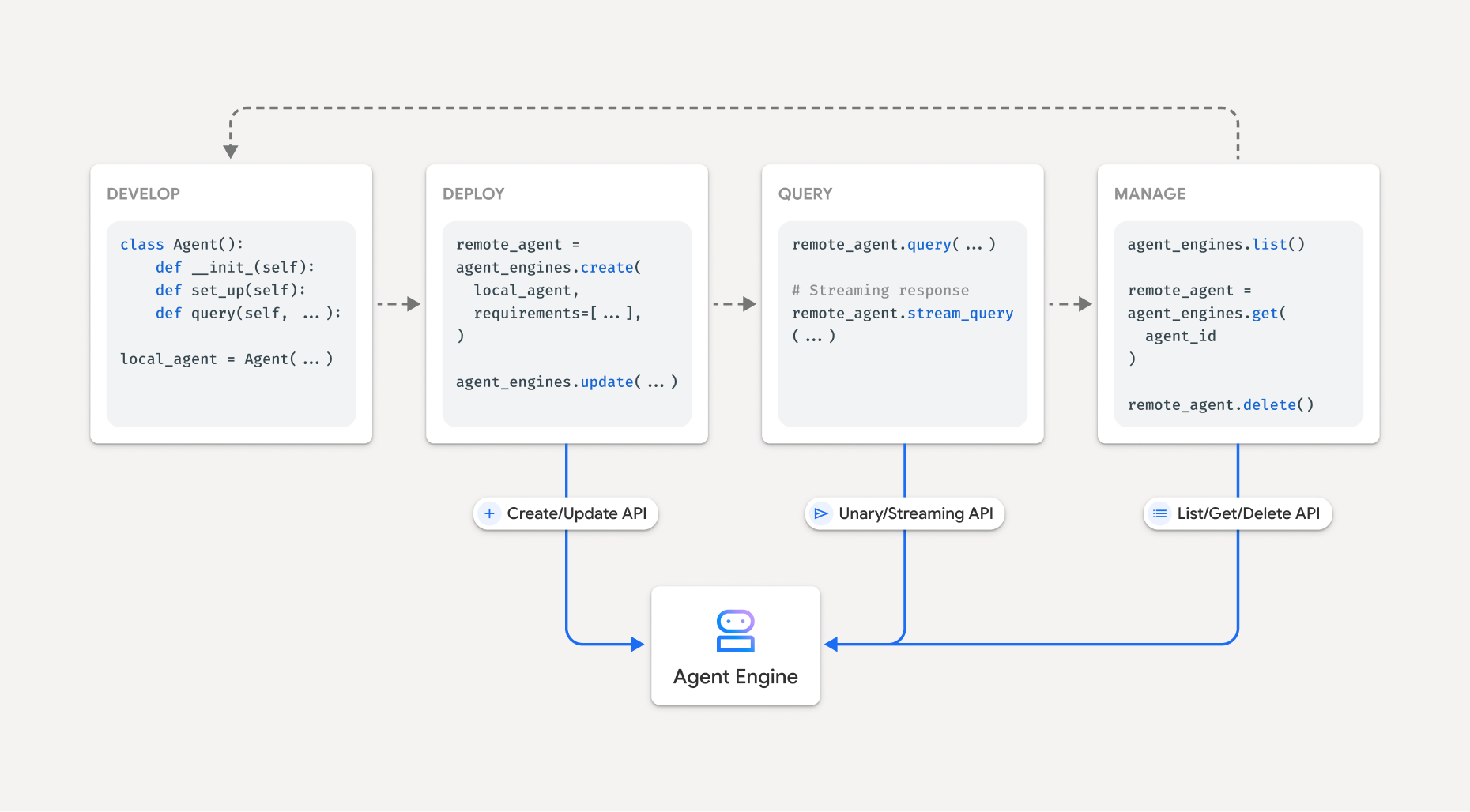

在 Vertex AI Agent Engine 上构建智能体的工作流如下:

| 步骤 | 说明 |

|---|---|

| 1. 设置环境 | 设置 Google 项目并安装最新版本的 Vertex AI SDK for Python。 |

| 2. 开发代理 | 开发可在 Vertex AI Agent Engine 上部署的智能体。 |

| 3. 部署智能体 | 将智能体部署在 Vertex AI Agent Engine 托管式运行时上。 |

| 4. 使用智能体 | 通过发送 API 请求来查询智能体。 |

| 5. 管理已部署的智能体 | 管理和删除已部署到 Vertex AI Agent Engine 的智能体。 |

这些步骤如下图所示:

支持的框架

下表介绍了 Vertex AI Agent Engine 为各种智能体框架提供的支持级别:

| 支持级别 | 智能体框架 |

|---|---|

| 自定义模板:您可以调整自定义模板,以支持从框架部署到 Vertex AI Agent Engine。 | CrewAI、自定义框架 |

| Vertex AI SDK 集成:Vertex AI Agent Engine 在 Vertex AI SDK 和文档中按框架提供托管式模板。 | AG2、LlamaIndex |

| 全面集成:这些功能已集成,可在框架、Vertex AI Agent Engine 和更广泛的 Google Cloud 生态系统中运行。 | 智能体开发套件 (ADK)、LangChain、LangGraph |

使用 Agent Starter Pack 在生产环境中部署

Agent Starter Pack 是一组可用于生产环境的生成式 AI 智能体模板,专为 Vertex AI Agent Engine 而打造。Agent Starter Pack 提供以下内容:

- 预构建的智能体模板:ReAct、RAG、多智能体和其他模板。

- 互动式平台:测试您的智能体并与之互动。

- 自动化基础设施:使用 Terraform 来简化资源管理。

- CI/CD 流水线:利用 Cloud Build 实现自动化部署工作流。

- 可观测性:内置对 Cloud Trace 和 Cloud Logging 的支持。

如需开始使用,请参阅快速入门。

使用场景

如需通过端到端示例了解 Vertex AI Agent Engine,请参阅以下资源:

企业级安全

Vertex AI Agent Engine 支持多项功能,可帮助您满足企业安全要求、遵守组织的安全政策,并遵循安全最佳实践。支持以下功能:

VPC Service Controls:Vertex AI Agent Engine 支持 VPC Service Controls,以加强数据安全性并降低数据渗漏风险。配置 VPC Service Controls 后,已部署的智能体会保留对 Google API 和服务(例如 BigQuery API、Cloud SQL Admin API 和 Vertex AI API)的安全访问权限,从而确保在您定义的边界内实现无缝操作。至关重要的是,VPC Service Controls 可有效阻止所有公共互联网访问,将数据移动限制在授权的网络边界内,从而显著改善企业安全状况。

Private Service Connect 接口:对于 Vertex AI Agent Engine 运行时,PSC-I 可让您的代理与用户 VPC 中以私密方式托管的服务进行交互。如需了解详情,请参阅将 Private Service Connect 接口与 Vertex AI Agent Engine 搭配使用。

客户管理的加密密钥 (CMEK):Vertex AI Agent Engine 支持 CMEK,以便您使用自己的加密密钥保护数据,从而获得用于保护 Google Cloud中静态数据的密钥的所有权和完全控制权。如需了解详情,请参阅 Agent Engine CMEK。

数据驻留 (DRZ):Vertex AI Agent Engine 支持数据驻留 (DRZ),以确保所有静态数据和使用中的数据都存储在指定区域内。

HIPAA:作为 Vertex AI Platform 的一部分,Vertex AI Agent Engine 支持 HIPAA 工作负载。

Access Transparency:Access Transparency 中的日志记录了 Google 员工在访问您的内容时所执行的操作。如需详细了解如何为 Vertex AI Agent Engine 启用 Access Transparency,请参阅 Vertex AI 中的 Access Transparency。

下表显示了每个 Agent Engine 服务支持哪些企业安全功能:

| 安全功能 | 运行时 | 会话 | 记忆库 | Example Store | 代码执行 |

|---|---|---|---|---|---|

| VPC Service Controls | 是 | 是 | 是 | 否 | 否 |

| 客户管理的加密密钥 | 是 | 是 | 是 | 否 | 否 |

| 数据驻留 (DRZ)(静态) | 是 | 是 | 是 | 否 | 否 |

| 数据驻留 (DRZ)(使用中) | 否 | 是 | 是* | 否 | 是 |

| HIPAA | 是 | 是 | 是 | 是 | 否 |

| Access Transparency | 是 | 是 | 是 | 否 | 否 |

* 仅在使用 Gemini 区域性端点时。

支持的区域

以下区域支持 Vertex AI Agent Engine 运行时、Agent Engine 会话和 Vertex AI Agent Engine 记忆库:

| 区域 | 位置 | 支持的版本 |

|---|---|---|

us-central1 |

艾奥瓦 | v1 支持正式版功能。v1beta1 支持预览版功能。 |

us-east4 |

北弗吉尼亚 | v1 支持正式版功能。v1beta1 支持预览版功能。 |

us-west1 |

俄勒冈 | v1 支持正式版功能。v1beta1 支持预览版功能。 |

europe-west1 |

比利时 | v1 支持正式版功能。v1beta1 支持预览版功能。 |

europe-west2 |

伦敦 | v1 支持正式版功能。v1beta1 支持预览版功能。 |

europe-west3 |

法兰克福 | v1 支持正式版功能。v1beta1 支持预览版功能。 |

europe-west4 |

荷兰 | v1 支持正式版功能。v1beta1 支持预览版功能。 |

europe-southwest1 |

马德里 | v1 支持正式版功能。v1beta1 支持预览版功能。 |

asia-east1 |

台湾 | v1 支持正式版功能。v1beta1 支持预览版功能。 |

asia-northeast1 |

东京 | v1 支持正式版功能。v1beta1 支持预览版功能。 |

asia-south1 |

孟买 | v1 支持正式版功能。v1beta1 支持预览版功能。 |

asia-southeast1 |

新加坡 | v1 支持正式版功能。v1beta1 支持预览版功能。 |

australia-southeast2 |

墨尔本 | v1 支持正式版功能。v1beta1 支持预览版功能。 |

对于 Agent Engine 代码执行(预览版),支持以下区域。

| 区域 | 位置 | 支持的版本 |

|---|---|---|

us-central1 |

艾奥瓦 | 支持 v1beta1 版。 |

Quota

以下限制适用于每个区域中给定项目的 Vertex AI Agent Engine:| 说明 | 限制 |

|---|---|

| 每分钟创建、删除或更新的 Vertex AI Agent Engine 数 | 10 |

| 每分钟创建、删除或更新的 Vertex AI Agent Engine 会话数 | 100 |

每分钟 Query 或 StreamQuery Vertex AI Agent Engine 数 |

90 |

| 每分钟向 Vertex AI Agent Engine 会话附加的事件数 | 300 |

| Vertex AI Agent Engine 资源数上限 | 100 |

| 每分钟创建、删除或更新的 Vertex AI Agent Engine 内存资源数 | 100 |

| 每分钟从 Vertex AI Agent Engine 记忆库中获取、列出或检索的次数 | 300 |

| 每分钟的沙盒环境(代码执行)执行请求数 | 1000 |

| 每个区域的沙盒环境(代码执行)实体数 | 1000 |

每分钟的 A2A 智能体 POST 请求数(例如 sendMessage 和 cancelTask) |

60 |

每分钟的 A2A 智能体 GET 请求数(例如 getTask 和 getCard) |

600 |

每分钟使用 BidiStreamQuery API 的并发实时双向连接数 |

10 |

价格

如需了解 Agent Engine Runtime 的价格,请参阅 Vertex AI 价格。

迁移到基于客户端的 SDK

Vertex AI SDK for Python 中的 agent_engines 模块正在重构为基于客户端的设计,主要原因如下:

- 为了与 Google ADK 和 Google Gen AI SDK 在规范类型表示方面保持一致。 这可确保以一致且标准化的方式在不同 SDK 中表示数据类型,从而简化互操作性并减少转换开销。

- 用于在多项目多位置应用中对 Google Cloud 参数进行客户端级范围限定。 这样,应用就可以通过为每个客户端实例配置特定的项目和位置设置,来管理与不同 Google Cloud 项目和地理位置的资源之间的互动。

- 提高 Vertex AI Agent Engine 服务的可发现性和凝聚力